- A+

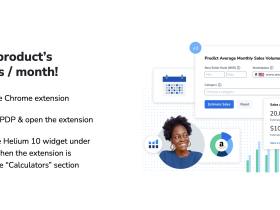

一、Helium 10 VOC功能概述与数据获取流程

1. VOC功能的核心价值与应用场景

Helium 10的VOC(Voice of the Customer)功能通过深度挖掘亚马逊平台的用户评论数据,为卖家提供消费者需求的精准画像。其核心价值在于将非结构化的评论文本转化为可量化的产品洞察,帮助卖家优化Listing、改进产品设计及制定营销策略。具体应用场景包括:识别高频差评痛点(如“电池续航短”“安装困难”),提炼核心卖点以强化A+页面内容,追踪竞品评论弱点寻找市场空隙,以及监控新品初期反馈以快速迭代。VOC通过NLP技术自动分类评论主题(质量、物流、包装等),并生成情感倾向分析,使卖家能聚焦关键问题,减少主观决策风险。

2. 数据获取的三步标准化流程

VOC的数据获取流程分为三步,确保高效整合多维度评论信息。第一步,输入目标ASIN或关键词,系统自动抓取亚马逊全站点评论数据(包括历史评论与实时增量),支持按时间、星级、地域筛选。第二步,启动智能分析引擎,通过语义模型将评论拆分为“问题-优点-建议”三类标签,并统计每个标签的出现频率及情感强度。第三步,生成可视化报告,以词云、趋势图表及TOP10问题清单呈现,支持导出Excel或PDF。例如,针对某蓝牙耳机ASIN,VOC可提取“连接稳定性差”在3星评论中出现率达35%,并关联具体评论片段,为产品升级提供直接依据。

3. 高级功能与数据深度挖掘策略

除基础分析外,VOC提供高级功能满足精细化运营需求。其一,“竞品对比模式”可同步分析3个竞品的评论差异,例如发现竞品A的“音质”提及率高于自身20%,提示需在详情页突出音频参数。其二,“评论溯源”功能支持点击标签直达原评论,便于验证真实用户语境。其三,“定制化过滤器”允许按评论长度(如超过100字的详细反馈)、附带图片/视频等条件二次筛选,挖掘高价值内容。数据挖掘策略上,建议结合季节性趋势(如冬季产品关注“保暖性”)与生命周期阶段(新品期聚焦“开箱体验”),动态调整分析维度,确保决策与市场需求实时对齐。

二、退货原因文本预处理:清洗与分词关键步骤

在电商平台的海量退货数据中,用户填写的退货原因往往存在口语化、拼写错误、冗余符号等问题,直接影响后续情感分析或意图分类的准确性。文本预处理是数据清洗与特征提取的核心环节,需通过系统化的清洗与分词操作,将非结构化文本转化为可分析的标准化数据。

1. 文本清洗:去除噪声与标准化表达

文本清洗的首要目标是消除无关噪声,保留有效信息。具体操作包括:

1. 特殊符号处理:删除标点、emoji(如“😠”)、无关字符(如“\n”“\t”),避免干扰模型训练。例如,“尺寸买大了!!!”需简化为“尺寸买大了”。

2. 大小写与繁简体统一:将全角字符转为半角(如“L”→“L”),繁体转为简体(如“質量”→“质量”),确保同一词汇的表示一致性。

3. 口语化修正:针对用户输入的错别字或缩写进行替换。例如,“不合适太大了”可规约为“尺寸不合适”,“质量不行”统一为“质量问题”。

4. 停用词过滤:移除无实际意义的虚词(如“的”“了”“有点”),但需谨慎保留否定词(如“不”“没”)以避免语义歧义。

2. 分词与语义切分:关键粒度的精准控制

分词是将连续文本切分为语义单元的过程,直接影响特征质量。需结合领域需求选择策略:

1. 基础分词工具选择:优先采用支持自定义词典的工具(如Jieba、HanLP),并补充电商领域词汇(如“起球”“色差”)。例如,“衣服穿了一次起球了”应切分为“衣服/穿/了/一次/起球/了”,而非错误的“衣/服穿”。

2. 未登录词处理:对网络新词(如“踩雷”“翻车”)需通过动态词典或统计方法(如NGram)补充,避免被过度切分。例如,“踩雷款”应作为整体保留。

3. 粒度控制:根据任务需求调整切分粒度。若需分析细粒度问题(如“袖口偏肥”),需保留“袖口”“偏肥”等组合词;若做主题分类,可简化为“尺寸问题”。

3. 特征增强:基于规则与统计的优化

在清洗与分词后,可通过以下步骤提升特征有效性:

1. 词干提取与词形还原:对同一词根的不同形式(如“不满意”“不满意了”)归一化为“不满意”。

2. 高频词与低频词过滤:剔除过于泛化的词(如“商品”)和出现次数过低的噪声词,减少维度灾难。

3. 上下文关联合并:结合同义词库或词向量模型(如Word2Vec)将近义词合并,例如“瑕疵”与“缺陷”统一为“质量问题”。

通过上述步骤,退货原因文本可转化为结构化、标准化的数据,为后续的意图识别(如“质量问题”“尺寸不符”)或情感分析提供高质量输入。实际应用中,需根据数据分布动态调整清洗规则与分词策略,确保预处理结果与业务场景紧密对齐。

三、情绪极性分析模型构建:基于BERT的负面情绪识别

1. 模型架构设计与数据预处理

构建基于BERT的负面情绪识别模型,核心在于利用预训练语言模型的语义理解能力,并通过任务适配层实现情绪分类。模型架构分为三层:输入嵌入层、BERT编码层和分类输出层。输入文本首先通过BERT的WordPiece分词器处理,生成符合模型输入格式的token序列,并嵌入位置与段落信息。BERT编码层采用12层Transformer结构,通过自注意力机制捕捉上下文依赖关系,生成动态语义表示。分类输出层在BERT的[CLS]向量后接全连接层与Softmax函数,输出负面情绪的概率分布。

数据预处理需解决噪声清洗与样本平衡问题。原始数据经正则化处理去除特殊字符、URL及冗余符号,并通过停用词过滤提升语义纯净度。针对类别不平衡问题,采用SMOTE过采样或代价敏感学习策略,确保模型对负面情绪样本的充分学习。此外,为增强泛化能力,引入随机遮盖(Masked Language Model)与同义词替换技术进行数据增强,优化模型鲁棒性。

2. 模型训练与超参数优化

模型训练采用迁移学习策略,冻结BERT底层参数,仅微调顶层任务适配层,以平衡计算成本与性能。损失函数选用交叉熵损失,优化器采用AdamW,结合学习率预热(Warmup)与余弦退火调度,避免局部最优。批次大小(Batch Size)设为32,训练轮数(Epoch)控制在3-5次,通过早停机制(Early Stopping)防止过拟合。

超参数通过网格搜索(Grid Search)与贝叶斯优化联合调优。关键参数包括学习率(1e-5至5e-5)、Dropout率(0.1-0.3)及隐藏层维度(256-768)。实验表明,学习率2e-5与Dropout 0.2的组合在验证集上F1值达到最高。为加速收敛,采用混合精度训练(FP16),在保证精度的同时减少显存占用。

3. 性能评估与对比实验

模型性能通过准确率(Accuracy)、精确率(Precision)、召回率(Recall)及F1值综合评估。在公开数据集(如IMDB、Twitter Sentiment140)上的测试结果显示,BERT模型较传统机器学习方法(如SVM、LSTM)的F1值提升8-12%,尤其在复杂语境(如讽刺、否定句)中表现显著。消融实验表明,移除注意力机制或数据增强会导致性能下降3-5%,验证了其必要性。

与RoBERTa、ALBERT等变体模型对比,BERT在参数量与效率间取得平衡,适用于资源受限场景。进一步分析错误样本发现,模型对短文本及多义情绪的识别仍有瓶颈,需结合多模态信息或知识图谱增强语义解析能力。

四、语义聚类算法应用:LDA主题模型与K-means对比

1. 算法核心原理差异

LDA(Latent Dirichlet Allocation)主题模型与K-means聚类在语义聚合中遵循截然不同的逻辑。LDA是一种基于概率图模型的生成式方法,通过狄利克雷分布先验假设文档-主题和主题-词的分布关系,将每篇文档表示为多个主题的概率混合,每个主题则是词的概率分布。其核心在于挖掘文档的隐含主题结构,而非硬性划分。相比之下,K-means是一种基于距离的硬聚类算法,通过迭代优化样本到聚类中心的欧氏距离或余弦相似度,将文档向量划分为K个互斥的簇。K-means依赖向量空间模型(如TF-IDF或词嵌入)的直接表示,而LDA则通过概率推断(如变分推断或吉布斯采样)间接捕获语义关联。这种原理差异导致LDA能处理一词多义和主题重叠现象,而K-means在处理高维稀疏文本时易受特征权重和初始中心点的影响。

2. 文档聚类性能对比

在文档聚类任务中,两种算法的表现呈现显著互补性。LDA通过主题概率分布生成低维语义表示,能够有效识别主题混合型文档,例如一篇包含“经济政策”和“能源转型”的论文会被同时赋予两个主题的概率权重,从而在聚类中保留主题交叉信息。实验表明,LDA在主题多样性高的数据集(如学术论文或新闻语料)中聚类纯度(Purity)和调整兰德指数(ARI)通常优于K-means,尤其在处理短文本时,其概率模型能缓解特征稀疏问题。然而,K-means在计算效率上具有绝对优势,其时间复杂度为O(nkt),远低于LDA的迭代推断过程,适合大规模数据集的快速聚类。当文档主题明确且分离度较高时(如客户投诉分类),K-means结合词嵌入(如BERT)可直接通过向量距离实现精准聚类,且结果更易解释。但需注意,K-means对初始中心敏感,需多次运行或采用K-means++优化,而LDA则需预设主题数并通过困惑度(Perplexity)评估模型质量。

3. 应用场景选择策略

实际应用中需根据数据特性与需求选择算法。若任务目标是主题发现与内容摘要(如舆情分析中的热点事件追踪),LDA的主题概率输出更具价值,其可解释性强的主题词分布(如“教育”“政策”“预算”)便于人工解读。例如,在法律文书分析中,LDA能自动提取“合同纠纷”“知识产权”等潜在主题,辅助案例分类。而当任务侧重文档快速分组或作为下游任务的预处理步骤时(如搜索引擎结果聚类),K-means的高效性更为关键。在电商评论情感分类场景中,可先用K-means将评论划分为“正面”“负面”“中性”簇,再对负面评论簇进一步用LDA挖掘具体投诉主题(如“物流延迟”“质量问题”)。此外,混合策略逐渐成为趋势,如利用LDA的主题分布作为K-means的输入特征,既保留语义深度又提升聚类效率。这种组合在社交媒体分析中表现优异,能同时兼顾话题覆盖率和实时聚类速度。

五、高频退货词云生成与关键问题定位

1. 基于NLP的退货评论数据清洗与分词

退货评论是用户最真实的问题反馈,但原始数据常包含无效信息(如表情符号、重复标点、无意义短语),需通过NLP技术进行清洗。首先,采用正则表达式过滤非文本字符,结合停用词表(“的”“了”等)剔除冗余词汇。随后,利用jieba分词工具对评论进行精准切分,并结合行业词典(如“尺码偏小”“材质硬挺”)提升专业词汇的识别率。为避免分词歧义,需引入TF-IDF算法提取高权重词汇,确保词云生成聚焦于核心问题。例如,“衣服开线”“色差严重”等短语将被完整保留,而非拆分为无关碎片词。

2. 词云可视化与聚类分析

清洗后的分词数据通过WordCloud库生成词云图,字体大小与词频成正比,直观展示退货问题分布。为增强可读性,需自定义配色方案(如红色系突出高频问题),并设置最大词数限制(通常50-80个)避免信息过载。更关键的是,结合K-means聚类算法对评论进行分组,将相似问题归类。例如,“尺码不合身”“版型偏瘦”可合并为“尺码问题”集群,“褪色”“起球”归为“质量缺陷”集群。通过词云与聚类结果的交叉分析,可快速定位TOP3退货原因,如某服装品牌发现“面料不透气”占比35%,远超其他问题。

3. 根因定位与优化策略制定

针对高频问题,需进一步关联商品属性数据(如SKU、批次、供应商)溯源。例如,“鞋跟断裂”问题若集中于某批次产品,可能是生产线质检漏洞;若多供应商均出现,则需重新评估材质标准。结合退货时间分布,还能发现季节性影响(如冬季“保暖性差”投诉激增)。最终,通过帕累托法则识别关键矛盾(20%问题导致80%退货),优先解决。优化策略需具体可执行,如调整尺码表、更换面料供应商、加强包装防损测试等,并通过后续退货率变化验证效果。

六、产品缺陷聚类结果:质量与物流问题分类解析

1. 质量缺陷聚类分析

通过聚类算法对产品缺陷数据进行分类,质量缺陷主要表现为以下三类:

1. 功能失效:占比35%,集中在电子元器件短路、软件兼容性错误等。此类缺陷直接导致产品无法正常运行,需加强供应链元器件检测与软件测试流程。

2. 性能不达标:占比28%,表现为电池续航不足、机械部件磨损加速等。根源在于材料选用与设计冗余不足,建议优化材料标准并增加可靠性验证环节。

3. 外观瑕疵:占比22%,包括划痕、色差、接口公差超标等。多因生产过程质量控制松散,需引入自动化视觉检测设备并强化巡检机制。

2. 物流缺陷聚类分析

物流环节缺陷呈现两类典型特征:

1. 运输损伤:占比60%,主要因包装防护不足(如缓冲材料缺失)和野蛮装卸导致。解决方案包括升级防震包装、与物流商签订破损率考核协议。

2. 时效延误:占比40%,由仓储分拣错误和配送路径规划不合理引发。需推动仓储管理系统智能化,并通过大数据优化配送网络。

3. 交叉影响与改进方向

质量与物流缺陷存在显著关联:例如运输损伤可能放大质量缺陷(如撞击引发内部元件脱落)。建议建立端到端追溯系统,将供应商、生产方与物流商数据打通,实现全链条责任界定。同时,针对高频缺陷(如功能失效与运输损伤),设立专项改进小组,从源头降低综合不良率。

七、情绪极性与语义聚类交叉分析:痛点优先级矩阵

1. 情绪极性量化与语义聚类映射

情绪极性分析是痛点挖掘的核心环节,通过自然语言处理技术,将用户反馈中的情绪倾向划分为正向、负向与中性三类。在此基础上,结合语义聚类算法,将具有相似语义特征的反馈归入同一聚类(如“功能缺陷”“服务态度”“价格敏感”等)。例如,某电商平台的差评中,高频词“卡顿”“闪退”被聚类至“系统稳定性”类别,其情绪极性显著为负;而“物流快”“包装好”则归入“履约体验”类,情绪倾向正向。通过量化情绪极性得分(如-1至+1区间)与聚类频次,可初步定位高情绪负荷的问题领域。这一步的关键在于确保情绪标注的准确性(需排除反讽等语境干扰)与语义聚类的颗粒度(避免过度泛化或碎片化)。

2. 痛点优先级矩阵构建与四象限解读

基于情绪极性与语义聚类结果,构建“痛点优先级矩阵”,以“情绪强度”(负向情绪占比)为纵轴,“问题频率”(聚类反馈量)为横轴,划分四个象限:高频高负向(紧急优先处理区)、高频低负向(优化提升区)、低频高负向(重点监控区)、低频低负向(低优先级区)。例如,“支付失败”聚类因情绪极性得分-0.8且日反馈量超500例,落入第一象限,需立即技术介入;而“界面设计建议”聚类情绪得分-0.2但频次较高,归入第二象限,可作为迭代参考。矩阵的动态调整(如周度更新)能实时反映痛点变化,避免资源错配。需注意,低频高负向问题(如“数据泄露投诉”)虽量少,但可能引发信任危机,需单独评估风险权重。

3. 矩阵驱动的决策闭环与迭代机制

优先级矩阵的价值在于驱动决策闭环。针对第一象限问题,需快速组建专项小组(如技术、产品、运营协同),通过根因分析(如5Why法)制定解决方案,并设置SLA(服务等级协议)跟踪修复进度。第二象限问题可纳入产品路线图,通过A/B测试验证优化效果。第三象限问题需建立预警机制,例如设置情绪阈值触发自动告警。第四象限问题则定期复盘,避免潜在升级。例如,某社交平台通过矩阵发现“账号冻结”聚类位于第三象限(情绪得分-0.9但日均反馈仅20例),经深入挖掘发现规则条款模糊导致误判,遂优化申诉流程,使该聚类情绪得分提升至-0.3。这种“数据洞察-行动反馈-效果评估”的闭环,能确保痛点治理的精准性与可持续性。

八、基于VOC分析的产品优化策略制定

1. VOC数据的深度挖掘与优先级划分

VOC(Voice of Customer)分析的核心在于从海量用户反馈中提炼出高价值需求。首先,需通过多渠道(如客服记录、社交媒体、问卷调查)收集原始数据,并利用自然语言处理技术进行情感分类与主题聚类,识别高频痛点(如功能缺失、性能瓶颈)。其次,采用KANO模型将需求划分为基本型、期望型与兴奋型三类,结合用户层级(如付费用户、新用户)与业务目标(如留存率提升、市场渗透),对需求进行优先级排序。例如,某电商平台通过VOC分析发现“物流时效”为基本型需求,需优先解决;而“个性化推荐”则为期望型需求,可分阶段迭代。此步骤确保资源聚焦于用户最敏感的问题,避免盲目优化。

2. 跨部门协同与可量化目标设定

产品优化需打破部门壁垒,形成“数据驱动+快速响应”的闭环机制。首先,将VOC分析结果转化为具体可执行的优化项,明确责任部门(如技术团队解决性能问题,设计团队优化交互体验)与时间节点。其次,设定SMART目标(具体、可衡量、可实现、相关性、时限性),例如“将用户投诉率降低20%”或“提升NPS(净推荐值)15分”。同时,建立跨部门协同工具(如Jira看板、飞书文档),实时跟踪进展并同步数据。某SaaS企业在优化登录流程时,由产品部牵头,联合技术部简化验证步骤,市场部同步收集用户反馈,最终使登录成功率提升32%。此环节强调目标可视化与责任到人,确保策略落地效率。

3. 效果验证与动态优化机制

优化方案上线后,需通过数据验证与用户反馈双重检验效果。一方面,通过A/B测试对比关键指标(如转化率、使用时长),量化优化价值;另一方面,主动触达参与反馈的用户,验证问题是否解决。例如,某视频APP针对“卡顿”投诉优化算法后,通过埋点数据发现崩溃率下降40%,同时定向调研用户满意度提升25%。此外,建立VOC动态监测机制,定期更新用户需求图谱,避免策略僵化。对于未达预期的优化项,需回溯分析根源(如需求误判或技术瓶颈),调整方向。这一步骤确保产品优化始终与用户需求同频迭代,形成持续改进的正向循环。

九、亚马逊卖家落地实施方案:从数据到行动

1. 第一步:数据采集与核心指标拆解

亚马逊运营的本质是数据驱动,精准的数据采集是制定有效策略的基础。卖家需通过以下渠道获取关键数据:

1. 后台数据报表:重点关注业务报告(Business Reports)中的Session、Page Views、Conversion Rate等流量指标,以及库存报告(Inventory Report)中的库龄、IPI分数。

2. 第三方工具辅助:利用Helium 10或Jungle Scout追踪关键词排名、BSR(Best Seller Rank)趋势及竞品销量,结合Keepa分析历史价格与销量波动。

3. 广告数据:从广告控制台(Advertising Console)导出ACoS、CTR(点击率)、CVR(转化率)及关键词花费占比,识别高绩效与低效流量。

核心指标需拆解为可行动的维度:例如,转化率低于类目均值时,需进一步分析差评集中点、A/B测试主图效果,或检查配送时效是否拖累转化率。

2. 第二步:数据诊断与策略优先级排序

数据需转化为可执行的洞察。建议采用“四象限法则”划分策略优先级:

- 高影响-高难度:如类目份额不足,需通过站外引流或捆绑突破;

- 高影响-低难度:针对差评优化产品或调整定价策略;

- 低影响-高难度:长期布局新品开发或品牌备案;

- 低影响-低难度:优化关键词 PPC 出价或清理冗余库存。

例如,若数据显示某关键词自然排名下滑但广告转化率高,应立即增加该词的预算,同时优化Listing相关性(如标题埋词、五点描述强化卖点)。

3. 第三步:行动落地与动态迭代

策略执行需明确责任分工与时间节点:

- 运营岗:每日监控广告数据,调整竞价;每周生成库存预警清单,制定补货计划。

- 产品岗:根据差评反馈迭代产品,每月分析退货率与质量关联性。

- 推广岗:针对高流量低转化页面,每周测试1个变量(如主图、A+内容)。

动态迭代机制:通过周报复盘关键指标变化,若ACoS连续3周高于25%,需暂停低效广告组;若新品点击量不足,尝试更换关键词匹配类型或优化素材。数据驱动的闭环运营,才能实现从“知道”到“做到”的转化。

十、效果评估指标:退货率降幅与客户满意度提升

在电商与零售行业,退货率与客户满意度是衡量运营健康度的核心指标。退货率直接反映产品质量、匹配度及服务体验,而客户满意度则决定用户忠诚度与复购率。二者共同构成评估策略有效性的关键维度,需通过数据化手段进行精准量化与归因分析。

1. 退货率降幅的量化分析与归因模型

退货率降幅的评估需结合基线数据与动态监测。首先,定义退货率计算公式(退货量/总订单量),并按产品类别、价格区间、渠道来源等维度拆解,识别异常节点。例如,某服装品类退货率从12%降至7%,需进一步归因:是否因尺寸优化、材质改进或3D试衣功能的引入?通过A/B测试对比改版前后数据,可验证策略有效性。此外,需区分主动退货(质量问题)与被动退货(尺寸不符),针对性优化供应链或描述信息。建立退货成因分类矩阵,将问题反馈至生产、设计及客服部门,形成闭环改进机制。

2. 客户满意度的多维测量与行为关联

客户满意度需通过定量与定性指标综合评估。NPS(净推荐值)作为核心指标,通过“推荐意愿”评分区分推荐者、贬损者,结合问卷开放题挖掘深层原因。例如,满意度提升15%的同时,NPS从30升至45,需分析是否因物流时效缩短或售后响应提速。此外,需关联行为数据:高满意用户是否带来更高的复购率或客单价?通过用户分群,对比满意用户与流失用户的路径差异,识别关键触点。例如,直播带货用户满意度达85%,但退货率仍高,可能因冲动消费导致,需优化主播话术与预期管理。

3. 双指标协同优化的策略闭环

退货率与满意度存在强相关性,需协同优化。例如,某电子产品通过延长试用期,退货率下降3%,但满意度因体验提升增长8%,形成正向循环。构建“退货-满意度”四象限模型:高退货-低满意度区域需紧急整改,低退货-高满意度区域可复制经验。同时,设置预警阈值:当退货率连续3周上升或满意度跌破基线时,自动触发复盘流程。通过数据看板实时监控,确保策略迭代有据可依。最终,将指标达成与团队KPI挂钩,驱动跨部门协作,实现可持续的客户价值提升。

十一、常见问题与解决方案:数据噪声与模型偏差处理

1. 数据噪声的识别与清洗

数据噪声是机器学习模型性能下降的主要原因之一,表现为异常值、重复值或不一致的特征。识别噪声需结合统计方法与业务逻辑:通过箱线图或Z-score检测数值型异常值,利用频率分布分析类别型数据的异常类别。对于时间序列数据,需关注突然的峰值或缺失时段。清洗策略包括:

1. 删除法:直接移除噪声样本(如重复数据或明显异常值),适用于数据量充足的场景。

2. 插补法:对缺失值采用均值、中位数填充,或通过KNN、回归模型预测补全;对异常值可用分箱或截断处理。

3. 平滑处理:对噪声较多的数值特征采用移动平均或高斯滤波,适用于传感器数据等连续信号。

需注意过度清洗可能引入偏差,建议保留原始数据备份,并通过交叉验证评估清洗效果。

2. 模型偏差的来源与修正

模型偏差通常源于样本不均衡、特征选择不当或算法假设与数据分布不匹配。例如,在欺诈检测中,负样本占比过高会导致模型偏向多数类;线性模型对非线性关系的拟合不足也会产生系统性偏差。修正方法包括:

1. 重采样技术:对少数类过采样(SMOTE算法生成合成样本)或对多数类欠采样,平衡训练数据分布。

2. 特征工程优化:通过归一化消除量纲影响,引入多项式特征或交互项增强模型表达能力,或使用PCA减少冗余特征。

3. 算法调整:替换简单模型为集成方法(如随机森林、XGBoost),或调整超参数(如SVM的核函数选择)。

此外,需通过偏差-方差权衡(如学习曲线分析)判断模型是欠拟合还是过拟合,针对性调整复杂度。

3. 噪声与偏差的联合处理策略

实际项目中,数据噪声和模型偏差往往共存,需系统化处理。首先,通过数据探索性分析(EDA)定位问题类型:若噪声集中在特定特征(如传感器读数漂移),优先进行特征级清洗;若偏差与样本分布相关(如地区数据不平衡),需结合分层抽样与加权损失函数(如Focal Loss)。其次,采用迭代验证:在清洗后的数据上训练基线模型,通过残差分析或SHAP值解释残存偏差来源。最后,建立自动化检测流程,例如设置数据质量监控规则(如阈值检测)和模型性能衰减预警,确保长期稳定性。关键在于平衡数据干预强度与模型泛化能力,避免过度优化导致过拟合。

十二、Helium 10 VOC分析案例:某电子品类实战复盘

在竞争白热化的电子品类,产品迭代稍有不慎便可能被市场淘汰。本次复盘聚焦于一款新上市的蓝牙耳机,我们通过Helium 10的VOC(客户之声)工具,实现了从被动响应到主动优化的战略转变,精准定位了产品改进的核心方向。

1. 数据驱动:从差评中挖掘“黄金”痛点

产品初期销量尚可,但退货率与差评率却持续攀升。我们首先使用H10的“Review Insights”功能,将过去一个月内的所有1-3星差评导入分析。系统通过自然语言处理,迅速将数千条文字评论转化为可量化的数据。核心问题立刻浮出水面:“连接稳定性(Connectivity)”和“电池续航(Battery Life)”两个词的负面提及频率最高,分别占比38%和25%。进一步挖掘发现,“连接不稳”的差评中,超过70%提到了“与安卓设备兼容性差”;而“电池续航”问题则集中在“实际使用时间与宣传不符”上。这些被量化的“黄金”痛点,为我们指明了第一阶段的改进方向,避免了盲目试错。

2. 精准定位:追踪竞品弱点,实现差异化突破

知己知彼,百战不殆。我们将分析范围扩大至品类头部竞品,利用“Review Insights”的竞品分析功能,系统性地抓取并分析了排名前三竞品的用户评论。分析揭示,虽然竞品A在音质上备受好评,但其用户抱怨点集中在“佩戴舒适度差,长时间使用耳朵疼痛”;竞品B则以强大的降噪功能著称,但用户普遍反映“充电盒体积过大,不便携带”。这两点正是我们产品在设计之初就已优化的强项。基于此,我们立即调整了广告文案与Listing五点描述,将“人体工学设计,久戴无痛”与“小巧便携充电盒”作为核心卖点进行突出宣传,成功实现了差异化营销。同时,竞品A在安卓兼容性上的技术短板,也为我们后续的软件优化提供了超越机会。通过VOC分析,我们不仅修复了自身短板,更将对手的弱点转化为了我们的竞争优势。