- A+

一、Helium 10 数据接口与 Python 数据科学库集成架构

1. Helium 10 API 数据获取与预处理模块

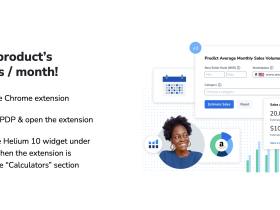

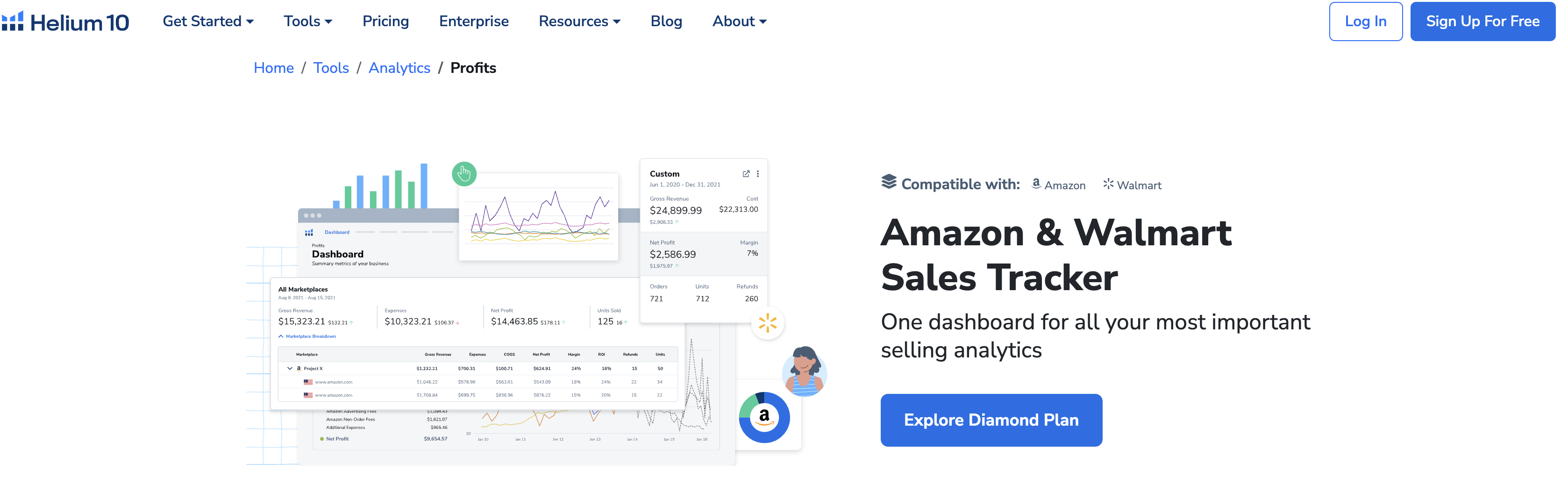

helium 10 提供的 RESTful API 是集成架构的核心数据源,支持通过 Python 的 requests 库实现高频、结构化的数据调用。首先需配置 OAuth 2.0 认证,动态获取访问令牌以确保会话安全。针对产品关键词排名、竞品销售数据等高频查询场景,采用异步请求机制(如 aiohttp)提升吞吐量,配合 tenacity 库实现失败重试与指数退避策略,保障数据完整性。获取的 JSON 原始数据通过 pandas.DataFrame 进行结构化解析,利用 json_normalize 展开嵌套字段,并结合 numpy 的向量化操作清洗异常值(如负价格、非标准日期)。对于时序型数据(如 BSR 趋势),使用 pandas.date_range 对齐时间粒度,确保后续分析的连续性。预处理阶段还需构建元数据字典,记录 API 端点、请求参数等上下文信息,便于后续审计与优化。

2. 多源数据融合与特征工程管道

Helium 10 数据需与外部数据源(如亚马逊广告报告、自定义市场调研数据)融合。通过 pandas.merge 基于共同键(如 ASIN、日期)执行横向拼接,或使用 concat 实现纵向扩展,形成统一数据仓库。针对特征工程,采用 scikit-learn 的 FeatureUnion 并行处理数值型与类别型特征:数值型特征通过 StandardScaler 标准化,类别型特征经 OneHotEncoder 编码为稀疏矩阵。对于文本型数据(如评论关键词),使用 nltk 进行词性标注与情感分析,提取 TF-IDF 特征向量。时序特征则通过 tsfresh 自动生成滞后项、移动平均值等衍生指标。构建 dask 分布式计算框架处理超大规模数据集,利用延迟计算机制优化内存占用,确保特征管道的可扩展性。

3. 模型训练与可视化输出闭环

基于处理后的特征矩阵,采用 xgboost.XGBRegressor 预测产品销量,或用 lightgbm.LGBMClassifier 进行潜在爆款识别。通过 scikit-learn 的 GridSearchCV 调参,结合 mlflow 记录模型版本与超参数。预测结果通过 plotly 生成交互式仪表盘:使用 Scatter 图展示关键词排名与销量的相关性,Heatmap 呈现竞品价格分布,Sankey 图分析流量路径转化漏斗。关键指标(如 ROI、ACoS)通过 dash 封装为实时监控看板,支持阈值告警。最终,模型输出与可视化报告通过 fastapi 暴露为 API 服务,供下游系统(如 ERP、广告自动投放平台)调用,形成数据驱动决策闭环。

二、亚马逊销量历史数据提取与预处理流程

1. 数据提取:构建多源数据采集体系

亚马逊销量历史数据的提取需整合官方API与第三方工具。首选亚马逊MWS(Marketplace Web Service)或SP-API获取结构化数据,包括订单详情、产品ASIN、SKU、价格、库存状态等,通过分页查询与增量同步机制应对海量数据限制。对于非公开数据(如竞品销量),需结合第三方爬虫工具(如Helium 10、Jungle Scout)抓取Best Seller Rank(BSR)曲线,利用历史BSR与销量的回归模型估算销量值。数据提取频率需根据业务需求设定:实时场景采用流式采集(如Kafka队列),分析场景则可按日/周批量拉取。所有原始数据需以Parquet格式存储至分布式文件系统(如HDFS),确保后续处理效率。

2. 数据清洗:解决噪声与一致性问题

原始数据存在三类核心问题需系统性清洗。缺失值处理:对订单ID或ASIN等关键字段缺失的记录直接丢弃,价格或库存等可计算字段采用历史均值填充。异常值检测:通过IQR(四分位距)或Z-Score识别销量突变,例如BSR突增1000%可能源于刷单,需结合人工审核修正。格式统一:将货币字段转换为标准数值(如$19.99→19.99),时间戳统一为UTC格式并按小时对齐,产品名称需去除HTML标签及冗余描述。对于多语言站点数据,需建立ASIN-global SKU映射表,确保跨区域数据关联。

3. 特征工程:构建可分析数据集

预处理后的数据需转化为特征矩阵。时间维度:生成订单日期(年/月/日)、星期、是否节假日等特征,识别季节性规律。产品维度:合并商品属性(类目、尺寸、颜色)与运营数据(促销标记、广告花费),计算转化率(订单量/点击量)。竞争维度:引入竞品BSR均值、价格分位值等指标,通过滑动窗口计算7日/30日移动平均销量。最终数据集按ASIN+日期聚合,输出至特征存储(如Redis或Hive),支持后续的销量预测模型训练与可视化报表生成。整个过程需通过Airflow或Prefect实现工作流编排,确保数据管道的定时调度与错误重试。

三、基于 Pandas 的销量数据特征工程方法

1. 时间序列特征构建

销量数据通常具有强时间依赖性,通过Pandas的时间序列功能可高效提取周期性、趋势性特征。首先,利用pd.to_datetime()将日期列转换为时间索引,并通过resample()按日、周、月聚合数据,计算滑动窗口统计量(如7日均销量、30日销量标准差)。其次,提取时间分解特征,包括星期几(dt.dayofweek)、是否为周末(dt.weekday >=5)、月份(dt.month)及季度(dt.quarter),捕捉季节性波动。此外,可使用shift()生成滞后特征(如前一期销量)或差分特征(本期减上期),以量化销量变化趋势。

2. 衍生变量与统计特征

基于原始销量数据,可通过数学运算和统计函数生成高阶特征。例如,计算环比增长率((当前销量-上期销量)/上期销量)或同比增速((本月销量-去年同期销量)/去年同期销量),反映短期与长期动态。利用groupby()结合agg()可生成分组统计特征,如按产品类别计算销量均值、中位数或极差,用于刻画不同类别的分布差异。此外,可构建交互特征,如“促销标识 × 品牌热度”的乘积项,通过布尔值(促销期标记为1)与数值型特征(品牌搜索量)相乘,捕捉协同效应。

3. 异常值处理与编码转换

特征工程需兼顾数据质量与模型兼容性。针对销量异常值,可通过四分位距(IQR)定义边界(Q1-1.5IQR至Q3+1.5IQR),用clip()限制极端值,或使用中位数替代离群点。类别型变量(如渠道类型)需转换为数值形式,独热编码(pd.get_dummies())适用于低基数类别,而高基数类别(如商品ID)可使用目标编码(按类别分组计算销量均值)以避免维度爆炸。最后,对特征进行标准化((x-μ)/σ)或归一化((x-min)/(max-min)),确保不同量纲特征可比性,提升模型收敛效率。

四、时间序列模型在销量预测中的应用

时间序列模型是销量预测的核心工具之一,通过挖掘历史数据中的趋势、季节性和随机波动,为企业提供精准的销售决策支持。以下从模型选择与优化、实战应用案例两方面展开分析。

1. 模型选择与关键优化技术

销量预测需结合数据特性选择合适的模型。ARIMA(自回归积分滑动平均模型)适用于线性趋势数据,通过差分处理非平稳序列,结合参数优化(如网格搜索确定p、d、q值)提升精度。SARIMA(季节性ARIMA)进一步引入季节周期参数,适合服装、饮料等季节性明显的品类。对于非线性数据,Prophet模型能自动处理节假日效应和缺失值,而LSTM(长短期记忆网络)通过神经网络捕捉长期依赖关系,复杂数据集表现更优。优化时需关注:

1. 数据预处理:填充缺失值(线性插值或均值填充),异常值检测(3σ法则)。

2. 特征工程:添加滞后项、滑动窗口统计量(如7日均值),增强模型对近期波动的敏感性。

3. 交叉验证:采用时间序列分割(TimeSeriesSplit)避免未来信息泄露,确保泛化能力。

2. 实战案例:零售品类销量预测

某快消品牌需预测未来3个月单品销量以优化库存。数据准备阶段,收集2年日销量数据,清洗后识别出周末效应(周末销量比工作日高15%)和促销影响(促销期销量增长30-50%)。模型构建:

- 基线模型:SARIMA(周期=7)捕捉周度规律,MAPE(平均绝对百分比误差)为18%。

- Prophet模型:加入促销日历和节假日哑变量,MAPE降至12%。

- LSTM集成模型:结合天气、竞品价格等外部特征,误差进一步压缩至8%。

结果应用:模型输出95%置信区间,指导安全库存设定。例如,预测某洗发水下月销量为1200±100瓶,结合供应商交付周期,将库存目标调整为1300瓶,既避免缺货又减少过量囤货成本。最终库存周转率提升22%,滞销损失降低35%。

通过合理选择模型并针对性优化,时间序列分析可显著提升销量预测的准确性与商业价值,成为企业精细化运营的关键技术支撑。

五、机器学习算法优化预测准确性实战

在机器学习项目中,模型的预测准确性直接决定了其商业价值与实用性。本章将聚焦于实战层面,通过系统化的优化策略,显著提升模型性能。以下将从特征工程与超参数调优两个核心维度展开,阐述具体操作方法与实战技巧。

1. 特征工程:挖掘数据深层价值

特征工程是提升模型准确性的首要环节,其核心在于通过数据预处理、特征构建与选择,最大化输入信息的质量与相关性。首先,数据清洗需完成缺失值填充(如均值插补或KNN临近填充)与异常值处理(如IQR法则剔除离群点),确保数据稳定性。其次,特征构建可通过组合现有特征生成高阶变量(如多项式特征或交互项),或通过领域知识衍生新特征(如时间序列中的滑动平均值)。最后,特征选择需结合过滤法(如相关系数分析)、包裹法(如递归特征消除)与嵌入法(如LASSO回归)筛选最优子集,降低维度灾难风险。例如,在金融风控模型中,通过整合用户历史行为特征与外部征信数据,可使AUC提升5%-8%。

2. 超参数调优:驱动模型性能突破

超参数调优是释放算法潜力的关键步骤,其目标是通过系统性搜索找到最优参数组合。网格搜索(GridSearchCV)适用于参数空间较小的场景,通过遍历所有候选组合确定全局最优解;而随机搜索(RandomizedSearchCV)则以牺牲部分精度换取效率,适合高维参数空间。贝叶斯优化(如Hyperopt)则基于高斯过程构建代理模型,智能迭代逼近最优解,显著减少计算成本。以XGBoost回归模型为例,通过调整max_depth(控制树深度)、learning_rate(学习率)与subsample(样本采样比例)等核心参数,可降低过拟合风险,使RMSE(均方根误差)下降10%以上。此外,交叉验证(如5折CV)需贯穿调优过程,确保结果泛化性。

3. 集成学习与模型融合

当单一模型性能受限时,集成学习可通过组合多个弱学习器提升整体预测能力。Bagging方法(如随机森林)通过自助采样降低方差,适用于高方差模型;Boosting方法(如AdaBoost、LightGBM)则通过串行训练纠正前序错误,对偏差敏感模型效果显著。模型融合(Stacking)进一步整合不同算法的预测结果,如将逻辑回归、SVM与神经网络作为基模型,以线性回归作为元模型,通常可使准确率提升2%-3%。在Kaggle竞赛中,融合XGBoost与深度学习模型的方案已多次刷新榜单记录,验证了其实战价值。

通过上述策略的协同应用,可系统性突破模型性能瓶颈。需注意,优化过程需结合具体场景动态调整,避免过度拟合或资源浪费,最终实现预测准确性与工程效率的平衡。

六、销量波动关键影响因素分析技术

精准识别并量化驱动销量波动的核心因素,是企业制定有效营销策略、优化库存管理及预测未来市场表现的关键。现代数据分析通过构建多维度分析框架,结合统计模型与机器学习算法,能够系统性地剥离复杂因素,揭示销量变动的内在逻辑。

1. 归因分析模型:精准量化内外部驱动因素

归因分析的核心目标是将销量的总波动分解为不同具体因素的贡献度。首先,必须构建一个全面的影响因素池,涵盖内部可控因素(如价格调整、促销活动、广告投放、渠道扩张)与外部不可控因素(如季节性周期、宏观经济指标、竞争对手动态、舆情变化)。技术上,多元线性回归是基础且高效的工具,其模型系数能直观反映各因素对销量的影响方向与强度。例如,通过回归分析可计算出“双十一”大促对当月销量的贡献率,或某竞品降价行为对我方销量的负面影响值。对于更复杂的非线性关系,则采用广义相加模型(GAM)或决策树算法,它们能捕捉价格弹性阈值、促销边际效应递减等细微模式。关键在于,所有分析必须基于A/B测试或严谨的准实验设计,以控制混杂变量,确保归因的准确性,避免将相关性误判为因果性。

2. 时间序列分解:洞察周期性与趋势性成分

销量数据本身是时间的函数,天然蕴含着长期趋势、季节性波动、周期性变动与随机噪声。时间序列分解技术,如经典的STL(Seasonal and Trend decomposition using Loess)方法,能将原始销量序列拆解为这三个可解释的组成部分。通过观察趋势项,可以判断品牌是处于增长、平台期还是衰退阶段。季节项则揭示了年度、月度甚至周度的固定销售规律,例如电商行业的“6·18”和“双十一”峰值,或快消品在节假日前后的销量攀升。更重要的是,在剔除了趋势和季节性影响后,残差项更能凸显由突发事件(如疫情封控、负面新闻)或特定营销活动引起的“异常”波动。这为评估临时性策略的净效提供了基准,也帮助企业建立更稳健的销量预测模型——先预测未来的趋势与季节,再叠加对已知事件的预期影响。

七、可视化仪表盘搭建与实时监控方案

1. 需求分析与技术选型

搭建可视化仪表盘前,需明确核心业务指标(如系统性能、用户行为、业务KPI等),并梳理数据源类型(数据库、日志、API等)。技术选型需兼顾实时性与可扩展性:

- 前端框架:推荐ECharts、Ant Design Charts或Grafana,前者适合定制化交互,后者开箱即用、支持多数据源。

- 实时数据管道:基于Kafka+Flink或Redis Streams处理流式数据,确保毫秒级延迟。

- 存储层:时序数据库(如InfluxDB)存储指标数据,关系型数据库(如PostgreSQL)管理元数据。

需避免过度复杂化,优先选择与现有技术栈兼容的工具链。

2. 仪表盘设计原则与模块化实现

仪表盘设计需遵循“关键指标前置、层级清晰、交互友好”原则:

1. 分层布局:顶部展示核心KPI(如QPS、错误率),中部为趋势图(CPU/内存使用率),底部为详细明细(日志或异常列表)。

2. 实时刷新:通过WebSocket或SSE协议推送数据,结合前端防抖策略(如1秒聚合更新)避免频繁渲染。

3. 模块化开发:将图表组件封装为独立模块(如折线图、热力图),支持动态配置与复用。关键代码示例(React+ECharts):

const RealTimeChart = ({ dataSource }) => {

const [data, setData] = useState([]);

useEffect(() => {

const ws = new WebSocket('ws://api.example.com/realtime');

ws.onmessage = (e) => setData(JSON.parse(e.data));

return () => ws.close();

}, []);

return <ReactECharts option={{ series: [{ type: 'line', data }] }} />;

};

3. 监控告警与性能优化

实时监控需配套自动化告警机制:

- 阈值告警:基于Prometheus+Alertmanager配置规则(如CPU>80%持续5分钟触发),通过钉钉/邮件通知。

- 性能优化:对高并发查询启用缓存(Redis),对历史数据采用降采样策略(如1分钟聚合为1小时)。

- 容灾设计:仪表盘服务需部署多实例,依赖数据库做主从备份,确保单点故障不影响监控。

最终方案需通过压力测试验证,确保仪表盘在10万+数据点/分钟的场景下仍保持流畅交互。

八、库存补货决策引擎逻辑设计

库存补货决策引擎是供应链管理系统的核心组件,其目标是在满足需求、控制成本和规避风险之间寻求最优平衡。该引擎通过整合多维数据输入,构建量化决策模型,实现从被动补货到主动预测的战略升级,确保库存健康度与资金周转效率。

1. 核心数据维度与加权算法

决策引擎的精准性依赖于全面的数据输入。首先,历史销售数据是基础,通过时间序列分析(如ARIMA模型)提取季节性、趋势性和周期性特征。其次,实时动态数据包括当前库存水位、在途订单量、安全库存阈值及供应商交付周期(Lead Time),其中交付周期需结合历史波动进行加权修正。第三,外部环境变量如市场促销计划、竞品动态、宏观经济指标及天气预报(尤其对生鲜、快消品行业)需纳入多变量回归模型。最终,通过动态加权算法(如熵权法或AHP层次分析法)为各维度数据分配权重,生成综合需求预测值(D_forecast)。例如,高季节性商品赋予历史销售数据更高权重,而新品则更侧重市场调研数据。

2. 多层级补货策略模型

基于需求预测值,引擎触发差异化补货策略。第一层为“安全库存再订货点”模型:当库存 ≤ 安全库存 + 预测期间需求时,触发基础补货量(Q_base = (订货周期+交货周期)×日均需求 - 当前库存)。第二层为“经济订货批量(EOQ)优化”:对长尾商品或高周转品,引入EOQ公式(Q=√(2DS/K))平衡订货成本(D为年需求量,S为单次订货成本,K为单位持有成本),并通过蒙特卡洛模拟验证参数敏感性。第三层为“动态博弈策略”:针对供应链波动场景(如供应商突发涨价或交付延迟),引擎调用预设规则库自动切换方案:若交付周期延长20%,则临时上调安全库存系数;若采购成本下降超过阈值,则触发战略性批量采购。所有策略输出均需通过“资金占用率”与“缺货风险概率”双重约束校验。

3. 执行闭环与机器学习迭代

决策引擎需构建“预测-执行-反馈-优化”闭环。补货指令下达后,系统实时追踪订单执行状态与销售兑现率,将实际值与预测值的偏差(如预测误差率MAPE)作为关键绩效指标(KPI)存入数据仓库。通过集成机器学习模块(如随机森林或LSTM神经网络),定期对历史决策结果进行回溯分析:当连续3个周期预测误差超过15%时,自动触发模型参数重训练。例如,某SKU因未考虑区域物流政策变更导致补货延迟,系统会学习该关联特征,在后续的交付周期预测中增加“政策风险因子”权重,实现决策模型的自主进化。

九、定价策略动态调整模型构建

动态定价策略的核心在于建立一个能够实时响应市场变化的数学模型,该模型通过多维度数据的输入与处理,输出最优价格决策。构建此模型需整合数据采集、算法引擎与反馈机制,形成一个闭环系统。以下从数据驱动基础与算法实现两个关键环节进行阐述。

1. 多维数据采集与特征工程

动态调整模型的精准度取决于数据的质量与广度。数据层需涵盖三类核心指标:其一,市场供需数据,包括实时库存量、竞品价格、用户搜索热度及行业价格指数;其二,用户行为数据,如历史购买记录、价格敏感度测试结果、加购/收藏转化率及促销活动响应曲线;其三,成本约束数据,包含边际成本、物流时效阈值及平台佣金浮动率。特征工程阶段需对原始数据进行降噪处理,例如通过时间序列分析剔除异常波动(如秒杀活动导致的瞬时峰值),并提取关键特征变量,如需求弹性系数(需求数量变化率与价格变化率的比值)、季节性因子(通过傅里叶变换分解周期性规律)及用户分层标签(基于RFM模型划分高价值/价格敏感型群体)。特征权重采用递归特征消除法动态优化,确保模型输入的冗余度低于5%。

2. 基于强化学习的算法引擎设计

算法层需满足实时性与自适应性的双重要求,采用强化学习(Reinforcement Learning, RL)框架尤为适宜。具体构建中,将定价系统定义为马尔可夫决策过程:状态空间(State)由实时库存、竞品价格矩阵及用户画像向量构成;动作空间(Action)为可调价格区间(如±10%的浮动范围);奖励函数(Reward)则关联多目标优化,包含短期收益(GMV增长率)、长期价值(用户留存率)及库存周转率。策略网络采用Actor-Critic架构,Actor网络输出价格调整概率分布,Critic网络评估动作价值以指导策略迭代。训练阶段引入经验回放池(Experience Replay)存储历史交易数据,通过重要性采样(Importance Sampling)解决数据分布不均衡问题。为避免探索成本过高,初始策略采用基于规则定价(如成本加成法)进行预训练,随后通过离线策略优化(Off-Policy Optimization)逐步过渡至自主决策。模型部署后需设置安全边界,例如价格单次调整幅度不超过3%,且24小时内累计波动不超过8%,确保商业风险可控。

通过上述数据与算法的协同,动态定价模型可实现毫秒级响应,在保证利润最大化的同时维持市场竞争力。后续需通过A/B测试持续验证模型效果,并根据业务迭代更新特征库与奖励函数。

十、预测结果验证与模型迭代机制

1. 预测结果的多维度验证体系

为确保模型预测的可靠性,必须建立一套系统化的验证流程。首先,数据层面的回溯测试是基础环节,通过将模型应用于历史数据集,对比预测值与实际值的偏差,量化评估模型的准确率、精确率、召回率及F1分数等关键指标。其次,场景模拟验证不可或缺,需构建极端市场环境(如黑天鹅事件、政策突变)的模拟场景,测试模型的鲁棒性与泛化能力。此外,交叉验证与A/B测试可进一步排除偶然性误差,通过划分独立数据集或并行运行新旧模型,确保优化后的性能提升具备统计显著性。验证结果需形成标准化报告,明确模型在不同维度的表现阈值,为迭代决策提供数据支撑。

2. 模型迭代的闭环反馈机制

模型迭代需遵循“验证-分析-优化-再验证”的闭环逻辑。当验证环节发现预测偏差超出容忍范围时,根因分析应优先展开:定位问题是源于数据质量(如噪声、特征缺失)、算法缺陷(如过拟合、参数不当),还是外部环境变化(如用户行为模式迁移)。针对数据问题,需启动数据清洗与特征工程优化;算法层面则可尝试调整超参数、更换模型架构(如从线性模型切换至集成学习);若环境变化导致模型失效,需引入增量学习机制,动态吸收新数据并更新模型权重。迭代过程中需记录每次优化的效果对比,避免无效调整,最终通过自动化CI/CD流水线部署新版本,确保迭代效率与稳定性。

3. 动态监控与自适应优化策略

为应对持续变化的外部环境,需建立实时监控系统,追踪模型在生产环境中的关键性能指标(如预测延迟、异常值占比),并设置预警阈值。当检测到性能衰减时,可触发自适应优化流程:轻度衰减时启动在线学习,通过小批量数据微调模型;严重衰退则需回滚至稳定版本,并启动紧急迭代。同时,引入用户反馈闭环,将实际业务场景中的修正标注数据反哺至训练集,形成“真实世界-模型预测-人工校验-模型进化”的良性循环。此外,定期开展模型漂移检测(如数据分布对比测试),确保模型与当前数据分布保持一致,从被动响应转向主动防御。

十一、自动化报告生成与预警系统开发

1. 数据采集与处理模块设计

自动化报告生成与预警系统的核心是高效的数据采集与处理。该模块需整合多源数据(如数据库、API接口、日志文件等),通过ETL(Extract-Transform-Load)流程实现数据清洗、转换与标准化。首先,采用定时任务(如Apache Airflow)或实时流处理(如Kafka+Flink)确保数据及时性;其次,利用正则表达式与机器学习算法识别异常值,提升数据质量。例如,通过缺失值插补与离群点检测,避免错误数据干扰后续分析。最终,处理后的数据存储至数据仓库(如Snowflake)或NoSQL数据库(如MongoDB),为报告生成奠定基础。

2. 报告生成引擎实现

报告生成引擎需支持动态模板与多格式输出。基于Python的Jinja2或Java的Thymeleaf模板引擎,可结合数据源生成Word、PDF或HTML报告。关键步骤包括:1)定义报告结构(如标题、图表、表格);2)通过数据绑定将处理后的指标填入模板;3)调用Matplotlib或ECharts生成可视化图表,并嵌入文档。例如,销售报告可自动汇总KPI完成率,并高亮未达标项。此外,需设计版本控制机制(如Git),确保模板更新可追溯,同时支持按需生成定制化报告,提升灵活性。

3. 预警逻辑与通知机制

预警系统需基于阈值规则或机器学习模型触发告警。静态阈值适用于明确指标(如CPU使用率超90%),而动态阈值(如基于环比/同比)可适应业务波动。高级场景采用异常检测算法(如Isolation Forest)识别潜在风险。一旦触发预警,系统通过多渠道(邮件、短信、钉钉机器人)推送消息,并附带解决建议。例如,库存预警可自动发送补货指令。此外,需设计告警抑制与升级策略,避免重复通知,确保关键问题及时响应。日志记录与反馈闭环(如告警处理状态跟踪)可持续优化系统灵敏度。

十二、跨平台部署与性能优化实践

1. 容器化部署与环境一致性保障

跨平台部署的核心挑战在于环境差异导致的兼容性问题。通过Docker容器化技术,可实现应用与底层操作系统的解耦,确保代码在开发、测试和生产环境中的一致运行。具体实践中,需优化Dockerfile以减少镜像体积,例如采用多阶段构建分离编译与运行环境,并使用Alpine等轻量级基础镜像。同时,Kubernetes集群管理工具可自动化处理跨节点调度与资源分配,通过声明式配置(如YAML文件)标准化部署流程。针对云服务商差异,可利用Helm Charts封装应用依赖,实现AWS、Azure和GCP等平台的快速迁移。

2. 性能瓶颈定位与代码级优化

跨平台性能优化需结合硬件特性与运行时环境分析。通过火焰图(Flame Graph)工具定位CPU热点函数,例如在Java应用中使用Async Profiler识别线程阻塞问题,或通过Chrome DevTools的Performance面板优化前端渲染逻辑。针对内存泄漏问题,可集成Valgrind(Linux)或Instruments(macOS)进行堆快照对比。在算法层面,采用SIMD指令集(如AVX)加速数据密集型任务,或通过WebAssembly弥补JavaScript在计算密集场景的性能短板。对于移动端,需关注渲染流水线优化,例如减少Android View层级或iOS离屏渲染次数。

3. 资源调度与动态优化策略

跨平台部署需动态适配不同硬件资源。基于Prometheus监控指标,实施弹性伸缩策略:当CPU使用率超过70%时,自动触发Kubernetes的Horizontal Pod Autoscaler扩容实例。针对边缘计算场景,采用函数计算(Function Compute)按需分配资源,例如在AWS Lambda中配置内存与超时参数以平衡成本与响应速度。对于游戏引擎等实时应用,可通过OpenCL或CUDA利用GPU并行计算能力,并在不同平台(Windows/Linux/iOS)通过条件编译优化指令集调用。最终,通过A/B测试验证优化效果,确保性能提升不引入新瓶颈。