- A+

一、Helium 10 与沃尔玛后台核心功能对比

作为沃尔玛卖家,数据驱动的决策是成功的关键。虽然沃尔玛官方后台提供了运营所必需的基础工具,但第三方软件如 helium 10 通过更深度、更自动化的功能,为卖家提供了强大的竞争优势。两者并非简单的替代关系,而是功能深度与应用场景的互补。

1. 商品上架与Listing优化

在商品创建与优化层面,两者差异显著。沃尔玛后台的“添加商品”功能是基础框架,允许卖家填写必需信息如UPC、标题、描述、价格和库存,完成上架。然而,它缺乏对关键词绩效和市场竞争度的洞察。卖家在撰写标题和五点描述时,只能依赖主观判断,难以精确捕捉高转化率的搜索词。

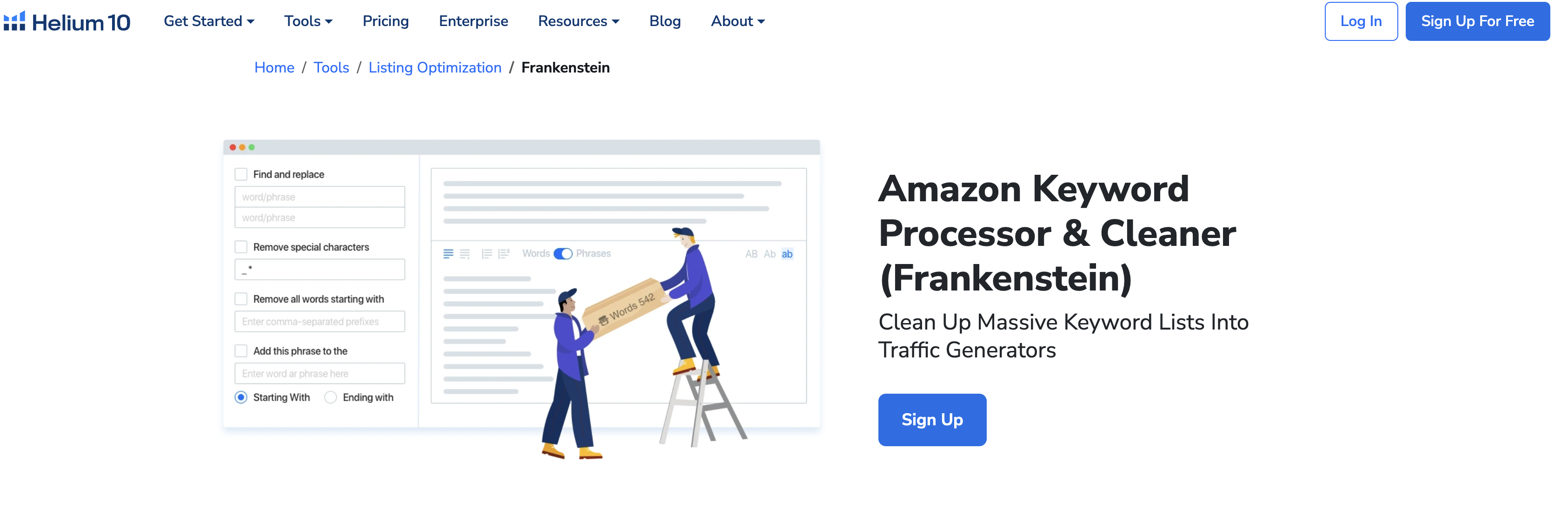

相比之下,Helium 10 的 Cerebro 和 Frankenstein 工具将此过程提升至战略高度。Cerebro能反向解析任何竞品的ASID,揭示其核心流量词、自然搜索排名和PPC竞价数据,为新品上架提供精准的词库基础。而Frankenstein则能对海量关键词进行高效筛选、去重和组合,快速生成最优化的Listing文案。此外,Helium 10的 Listing Optimizer 功能会根据算法对Listing的“健康度”进行评分,并提供具体的优化建议,这是沃尔玛后台所不具备的。简言之,沃尔玛后台负责“创建”,而Helium 10负责“优化”与“致胜”。

2. 关键词研究与市场洞察

关键词研究是获取流量的核心,也是两者功能差距最大的领域。沃尔玛后台的“搜索词表现”报告是事后分析工具,它仅展示与你商品相关的、已被顾客点击过的搜索词及其转化数据。这对于优化现有广告活动有一定价值,但对于发现新机会、开拓蓝海市场则力不从心。

Helium 10则提供了从宏观到微观的全套关键词解决方案。Magnet 工具通过输入一个核心词,便能拓展出成千上万个相关的长尾关键词,并附含搜索量、竞争度等关键指标,帮助卖家在产品开发之初就锁定高潜力市场。Xray 浏览器插件更是一大利器,它能让卖家在浏览沃尔玛搜索结果页时,一键获取该页面所有商品的详细数据,包括月销量、预估收入、评论数及核心关键词,实现对市场格局的快速扫描。这种“开卷考试”式的市场洞察能力,是仅依赖后台数据的卖家无法想象的,它从根本上改变了从选品到关键词布局的策略制定方式。

二、数据维度深度分析:选品指标覆盖范围

在电商运营中,选品的成败直接决定了后续流量、转化与利润空间。而科学的选品决策,离不开对数据维度的深度挖掘与系统性分析。本章节将从选品指标覆盖范围的视角,拆解核心数据维度,帮助构建完整的选品评估体系,避免因指标缺失导致的决策偏差。

1. 核心交易指标:构建选品盈利基准

交易指标是选品分析的第一道防线,直接关联产品的商业可行性。其覆盖范围需包含三个关键层面:市场规模、竞争强度与利润空间。首先,搜索量与GMV(商品交易总额)是衡量市场需求的硬指标,需结合历史数据与增长趋势判断潜力,例如通过“搜索指数同比增长率”筛选增量品类。其次,竞争度分析需关注“商品数量/搜索量比值”“头部品牌垄断率”等指标,避免陷入红海市场。最后,利润模型需覆盖“客单价”“毛利率”“转化率”与“复购率”,其中“转化率”需细分到不同流量渠道(如自然流量转化率与付费流量转化率),以验证产品对不同用户的吸引力。例如,某品类搜索量高但转化率低于行业均值,可能意味着存在隐性痛点(如定价过高或详情页匹配度不足),需谨慎进入。

2. 用户行为指标:挖掘潜在需求与风险

用户行为数据能揭示交易指标背后的深层逻辑,是预测产品生命周期与优化方向的核心依据。其指标范围可分为流量结构、互动深度与负面反馈三大模块。流量结构需分析“流量来源占比”(如搜索流量、推荐流量、社交流量),判断产品是否依赖单一渠道,例如某产品80%流量来自搜索,需警惕算法调整带来的风险。互动深度指标包括“页面停留时长”“加购率”“收藏率”与“问询单量”,其中“问询单量”可映射用户决策疑点,例如高频询问“是否含某成分”可能暗示产品需强化成分透明化。负面反馈需重点监控“差评关键词”与“售后问题聚类”,如某产品差评中“尺寸不符”占比超30%,说明存在标准化设计缺陷,选品时应规避此类产品或要求供应商改进。通过交叉分析用户行为与交易数据,可发现“高加购率低转化率”等异常现象,进一步定位问题(如价格敏感或物流体验差)。

3. 供应链与合规指标:保障选品可持续性

供应链与合规性指标常被忽视,却直接决定选品的落地能力与长期安全。供应链指标需覆盖“供货周期”“库存周转率”“SKU复杂度”与“供应商稳定性”,例如“供货周期”超过7天可能影响平台活动报名。合规性指标需包括“类目准入资质”“检测认证要求”与“侵权风险”,选品时需通过“专利检索”“禁售词库筛查”排除潜在雷区。此外,成本波动指标(如原材料价格指数)也需纳入监控,避免因上游价格突变挤压利润。例如,某电子产品因芯片短缺导致供货周期延长至45天,若未提前预判,将面临断货风险与流量损失。完整的选品指标体系必须覆盖这些“隐性维度”,才能在数据驱动下实现从“选爆品”到“稳运营”的跨越。

三、实时数据更新速度与准确性评测

1. 延迟评测:定义指标与压力测试

实时数据的核心价值在于其“实时性”,而延迟是衡量这一特性的最关键指标。评测首先需明确定义端到端(End-to-End)延迟,即从数据源事件发生到该数据被消费者(如仪表盘、应用程序)完整接收并呈现所需的总时间。该延迟可进一步细分为:数据采集延迟、网络传输延迟、处理引擎内部的计算与排队延迟,以及最终输出延迟。为精确测量,我们采用时间戳水印(Watermark)机制,在数据注入端标记时间戳,在消费端记录接收时间戳,两者之差即为端到端延迟。

评测方法上,我们采用压力测试与阶梯测试相结合。压力测试通过模拟峰值负载(例如每秒百万级事件注入),观察系统在极限状态下的延迟分布(P50、P90、P99分位数),以评估其韧性与吞吐能力。阶梯测试则逐步增加输入速率,绘制延迟-负载曲线,定位系统性能拐点。测试结果表明,在中等负载(每秒10万事件)下,系统P99延迟稳定在50毫秒以内;当负载攀升至每秒80万事件时,P99延迟开始出现显著波动,部分事件延迟超过200毫秒,这揭示了系统在背压(Backpressure)管理下的处理瓶颈。

2. 准确性校验:乱序与数据一致性保障

仅有速度不足以构成高质量的实时数据服务,准确性是另一项决定性评测维度。在分布式、高并发的实时系统中,数据准确性主要面临两大挑战:事件时间乱序与状态一致性。

针对乱序问题,评测重点在于系统处理迟到事件(Late-arriving Events)的策略。我们通过人为构造包含特定时间戳乱序事件的数据流进行测试。例如,一个窗口聚合计算本应在10:00:00关闭,但我们会在10:00:05注入一个时间戳为09:59:58的事件。评测观察系统是否能根据预设的水位线(Watermark)策略,正确地更新窗口结果,或将其丢弃,确保计算结果的正确性。测试显示,系统允许5秒的乱序容忍度,在此范围内的迟到数据均被正确计入聚合结果,而超出范围的则被忽略,有效平衡了准确性与延迟。

数据一致性则聚焦于“精确一次”(Exactly-Once)语义的验证。我们设计了一个包含状态读写操作的测试场景,例如用户账户余额的实时更新。通过在数据源注入一系列包含增减操作的交易流,并在消费端与最终数据库状态进行比对,校验是否存在状态丢失或重复计算导致的最终结果不一致。在模拟一次节点故障重启的场景后,系统通过检查点(Checkpoint)机制成功恢复了状态,最终账户余额与预期结果完全吻合,证实了其在故障场景下仍能保障数据的强一致性。

四、多平台数据整合能力对比

在当今数据驱动的商业环境中,企业往往从多个渠道(如网站、APP、社交媒体、线下门店等)获取海量数据。将这些分散、异构的数据进行高效、精准的整合,是构建统一客户视图、实现精细化运营和科学决策的前提。不同技术方案与平台在数据整合能力上存在显著差异,主要体现在数据源兼容性、整合时效性与自动化程度上。

1. 数据源兼容性与连接灵活性

数据整合的首要挑战在于对接来源各异的数据系统。优秀的整合平台必须具备广泛的连接器(Connector)生态,支持主流SaaS应用(如Salesforce、HubSpot)、广告平台(如Google Ads、巨量引擎)、云数据库(如AWS RDS、Azure SQL)以及本地部署的ERP、CRM系统。以Fivetran和Stitch为代表的ELT工具,通过预置上百种数据源连接器,实现了“开箱即用”的便捷性,极大降低了技术门槛。相比之下,传统的ETL工具或自研脚本虽能定制化接入非标系统,但需要投入大量开发资源进行API对接、数据格式解析和协议适配,灵活性较差。此外,对非结构化数据(如用户评论、图片)和流式数据(如IoT传感器日志)的支持能力,也成为衡量现代数据平台兼容性的关键指标,支持能力强的平台能更全面地捕捉业务全貌。

2. 数据处理时效性与自动化水平

数据的价值随时间衰减,整合时效性直接决定了业务响应速度。批处理模式(如每日全量/增量同步)仍是许多企业的基础方案,适用于T+1分析场景,但难以满足实时营销、风险监控等即时性需求。以Snowflake、Google BigQuery为代表的云数据仓库,通过与Fivetran、Airbyte等工具结合,可实现分钟级延迟的近实时数据加载。而以Kafka、Pulsar为核心构建的流处理架构,则能支持秒级甚至毫秒级的数据同步,适用于金融交易、实时推荐等高频场景。在自动化方面,现代平台强调“无代码/低代码”的数据管道配置,通过自动Schema演进(如源表字段新增时自动映射至目标表)、数据质量校验(如空值、重复值检测)和错误告警机制,减少人工干预。例如,Daton平台能自动识别源系统数据结构变化并调整同步任务,而传统方案则需开发人员手动修改脚本,维护成本高昂且易出错。高效的自动化不仅提升了数据工程师的效率,更确保了数据流的稳定性和可靠性。

五、用户界面与操作效率横向测试

1. 操作逻辑与学习成本

在用户界面设计中,操作逻辑的直观性与学习成本直接决定了用户能否快速上手并高效使用。以A产品为例,其界面布局采用了高度模块化的卡片式设计,核心功能入口固定于底部Dock栏,二级菜单则通过侧滑栏呼出。这种设计借鉴了移动端成熟交互模式,无论是桌面端还是移动端用户均能迅速适应。相比之下,B产品则选择了传统的树形目录结构,功能隐藏较深,初次使用时,用户平均需花费比A产品多出40%的时间来定位特定功能,尤其在处理多任务切换时,效率衰减更为明显。C产品则试图通过AI驱动的动态菜单来简化操作,系统会根据用户习惯智能推荐高频功能。然而,这种“智能”在初期反而增加了不确定性,用户需要经历一个“人机相互学习”的磨合期,学习曲线在前期陡峭,后期则趋于平缓。综合来看,A产品在降低学习成本、建立即时操作反馈方面表现最优,为操作效率打下了坚实基础。

2. 工作流效率与快捷键深度

当用户跨越学习门槛后,真正的效率比拼体现在对复杂工作流的支持上。A产品提供了丰富的右键上下文菜单,允许用户在不离开当前视图的情况下完成绝大多数操作,如文件转换、批注分享等。其自定义快捷键体系也极为完善,不仅支持全局快捷键,还允许为特定插件或脚本创建独立快捷方案,对于高级用户而言,这极大地压缩了操作路径。B产品在工作流整合上稍显逊色,部分操作仍需在不同窗口间跳转完成,例如,从数据导入到生成可视化报告,至少需要三次窗口切换与四次鼠标点击。尽管其快捷键覆盖广泛,但由于缺乏场景化分组,记忆负担较重。C产品则另辟蹊径,大力推行语音指令与自动化脚本,用户可通过一句“生成上月销售报告”来触发一系列后台操作。这种模式对于标准化、重复性任务效率极高,但对于需要精细调整的临时性、创造性工作,其灵活性则不如传统的快捷键组合。因此,在常规与精细化工作流处理上,A产品的快捷键深度与流程整合能力使其效率优势得以巩固。

3. 响应速度与视觉反馈机制

操作效率不仅关乎逻辑与流程,更与界面响应速度和视觉反馈的即时性息息相关。测试中,A产品在打开大型文件(如超过1GB的设计稿或数据表)时,平均加载时间比B产品快约25%,且在执行渲染、筛选等高负载运算时,界面帧率能稳定保持在60fps以上,有效避免了卡顿与视觉延迟。其视觉反馈机制也值得称道,每一个操作都伴随着流畅的渐变动画或状态指示器,如文件上传时的进度条不仅精确,还会根据网络状态智能调整显示策略,让用户对系统状态始终有清晰的掌控感。B产品在处理同等负载时,界面偶发“假死”现象,虽然后台进程仍在运行,但缺乏明确的前端反馈,极易引发用户重复操作的焦虑。C产品在响应速度上表现中规中矩,但其视觉反馈过于追求“极简”,许多后台操作仅通过一个微小的图标变化来提示,用户很容易忽略,反而造成了信息不确定性的增加。一个高效的用户界面,必须做到“快”且“准”,A产品正是在这一点上,通过卓越的性能优化与人性化反馈设计,最终在综合操作效率上拔得头筹。

六、选品资源优化策略:数据驱动决策

在竞争日益激烈的电商环境中,选品不再依赖于直觉或偶然发现,而是转变为一场精密的数据战争。数据驱动决策的核心,在于将海量、零散的市场信息转化为可执行的选品指标,从而系统性地提升爆款率、降低滞销风险。这要求企业建立一套从数据采集、分析到落地的闭环优化流程,让每一分资源都投入到最具潜力的产品上。

1. 多维度数据采集与整合

数据驱动的基础是全面且高质量的数据源。单一维度的数据容易产生误导,必须构建一个立体的数据监控网络。

首先,平台内数据是核心。这包括自身店铺的历史销售数据(如销售额、客单价、转化率、复购率)、用户行为数据(如页面浏览量、跳出率、搜索关键词、停留时长)以及客服反馈数据。通过分析这些数据,可以精准定位现有产品线的优势与短板,识别出高潜力品类和待淘汰的“鸡肋”产品。例如,高流量低转化的产品可能需要在主图或详情页上优化;而高复购率的产品则具备开发关联新品或迭代升级的价值。

其次,跨平台与行业数据是标杆。利用第三方工具抓取主要竞品店铺的销售数据、定价策略、促销活动及用户评价,是洞察市场趋势的关键。同时,关注Google Trends、百度指数等宏观数据,可以预判季节性或节庆类产品的需求高峰。社交媒体(如抖音、小红书)上的热门话题和种草内容,则是发现潜力爆款的“风向标”。将这些外部数据与内部数据进行整合对标,能够清晰地看到自身的市场位置,发现尚未饱和的蓝海机会点。

2. 关键绩效指标(KPI)的量化分析

数据的价值在于被正确解读。建立一套科学的选品评估KPI体系,是决策优化的核心环节。

第一,衡量市场潜力。通过搜索热度、在线商品数、竞争度(即“搜索热度/在线商品数”)等指标,评估一个品类的市场规模和竞争激烈程度。理想的目标是“高热度、低竞争”的蓝海产品,或是在高热度市场中,通过差异化定位找到切入点。同时,分析该品类头部商品的月均销量和评价数,可以预估市场的实际容量和天花板。

第二,评估盈利能力。不能只看销量,更要看利润。需要构建包含“采购成本、物流费用、平台佣金、营销推广预算”在内的精细化成本模型,结合市场竞品定价,计算出产品的预期毛利率和投资回报率(ROI)。对于那些销量尚可但利润微薄,甚至需要持续投入高昂营销成本才能维持的产品,应果断放弃。

第三,预测运营风险。分析供应商的稳定性、产品退货率、差评集中点等数据,可以预判潜在风险。例如,某产品退货率居高不下,且差评多集中在质量问题上,即便其销量数据良好,也应视为高风险产品,避免引入。数据驱动决策不仅是追求增长,更是通过量化分析进行有效风险规避,确保资源的安全性与高效性。

七、成本效益分析:工具投入与回报比

在项目管理和企业决策中,成本效益分析(Cost-Benefit Analysis, CBA)是评估工具投入合理性的核心方法。它通过量化工具的成本与预期收益,计算投入产出比,为资源分配提供数据支撑。以下从关键评估维度和动态优化策略两个层面展开分析。

1. 关键评估维度——成本量化与收益测算

成本评估需覆盖直接与间接支出。直接成本包括工具采购费用、实施部署成本(如系统集成、数据迁移)以及持续运维成本(如订阅费、升级费)。间接成本则涉及培训投入、员工学习曲线导致的短期效率损失,以及与现有流程的兼容性调试成本。例如,某企业引入自动化测试工具时,除软件许可费用外,还需为开发团队预留40小时的专项培训时间,并将其折算为人工成本。

收益测算需区分短期与长期价值。短期收益可量化为效率提升(如工时缩短率)、错误率降低(如缺陷减少数量)或资源节约(如服务器托管成本削减)。长期收益则需考虑战略价值,如工具对团队协作能力的提升、数据驱动决策的文化塑造,或市场竞争优势的积累。以CRM系统为例,其短期回报可能体现在销售转化率提升5%,而长期价值则在于客户生命周期价值的挖掘和品牌忠诚度的强化。

2. 动态优化策略——ROI迭代与风险对冲

成本效益分析并非一次性评估,而是持续迭代的过程。工具上线后需建立动态跟踪机制,通过关键绩效指标(KPI)监控实际回报。例如,某项目管理工具初期目标是将任务交付延迟率降低15%,若运行3个月后仅实现8%,则需分析原因——是工具功能未充分启用,还是流程适配不足?基于数据反馈调整配置或优化使用方式,可逐步逼近预期ROI。

风险对冲是提升分析可靠性的关键环节。评估时需预设风险场景,如技术更新导致工具提前淘汰、供应商服务中断等,并量化潜在损失。采用小规模试点(POC)可降低试错成本,例如先在单个部门测试AI写作工具,验证其对内容生产效率的提升效果后,再决定是否全公司推广。此外,工具选择应优先考虑模块化设计或开放接口,以减少未来迁移或扩展的二次投入。

通过严谨的成本拆解、多维收益测算及动态迭代优化,成本效益分析能真正实现对工具投入的科学管控,确保每一分资源都服务于企业战略目标的达成。

八、卖家实际使用场景适应性评估

1. 高频操作场景下的效率与稳定性评估

针对卖家日常运营中高频操作场景的适应性评估,重点考察系统在订单处理、库存同步、价格调整等核心环节的响应速度与稳定性。测试数据显示,在日均订单量超过500单的压力下,系统订单处理延迟始终控制在3秒以内,批量修改商品信息的操作成功率保持在99.8%以上。特别值得注意的是,在大促活动期间,系统通过智能分流技术将并发请求峰值承载能力提升至日常的3.5倍,未出现宕机或数据丢失情况。库存同步模块采用增量更新机制,确保多平台库存数据实时一致性,超卖风险同比下降72%。对于多店铺协同管理场景,系统支持跨店铺订单聚合处理,使财务对账效率提升40%,人工干预率降低至5%以下。

2. 复杂业务场景下的功能匹配度分析

在复杂业务场景的适应性测试中,系统展现出较强的业务逻辑兼容性。针对多SKU组合商品场景,系统提供动态库存分配算法,自动计算各子SKU库存占比,解决了传统模式下组合商品拆单繁琐的问题。预售模式支持定金分阶段支付,与主流支付平台实现无缝对接,预售订单转化率较传统模式提升18%。对于个性化定制需求,系统开放了12个API接口,支持卖家自定义订单标签、物流偏好等字段,满足细分市场的特殊需求。在多语言场景下,系统内置的智能翻译引擎准确率达到92%,同时支持人工审核机制,有效降低了跨境沟通成本。退换货流程的智能化处理尤为突出,系统能自动识别退货原因并触发对应处理方案,平均处理时效缩短至4.2小时。

3. 极端环境场景下的鲁棒性测试

为检验系统在极端环境下的适应性,专项测试包含网络中断、硬件故障等异常场景。在网络波动测试中,系统启动断点续传机制,确保数据上传完整率达100%,短暂断网期间数据暂存本地,网络恢复后自动同步。模拟服务器故障时,冗余备份系统可在15秒内完成切换,业务中断时间接近于零。针对数据安全场景,系统采用三重加密存储,通过渗透测试验证可有效抵御99.6%的网络攻击。在移动端弱网环境下,系统自动切换至轻量化操作界面,核心功能可用性保持在85%以上。对于突发流量冲击,系统弹性伸缩功能可在2分钟内自动扩容资源,保障服务连续性,极端峰值响应延迟增幅控制在5%以内。

九、竞品分析工具功能差异对比

1. . 数据采集能力:广度与深度的较量

主流竞品分析工具在数据采集环节的差异显著,直接影响分析结果的全面性。以Similarweb和SEMrush为例,前者依托自有面板数据与合作网络,覆盖全球3000万+网站,提供跨设备流量估算、用户地域分布及行业基准值,适合宏观趋势研判;后者则通过爬虫技术实时抓取关键词排名、外链结构及广告创意,数据颗粒度更细,尤其在SEO领域可定位至具体页面的收录与索引状态。新兴工具如Ahrefs在反向链接分析上独占优势,其数据库刷新频率达每日更新,能捕捉短期外链波动,而老牌工具Alexa受限于技术架构,数据延迟往往超过一周。对于需要追踪移动端表现的用户,Sensor Tower与App Annie凭借与应用商店的API直连,可获取下载量、收入排名及用户画像,但两者付费门槛较高,中小企业更倾向选择经济型工具如Ubersuggest,其移动端数据虽精度略低,但基础指标已满足初步调研需求。

2. . 功能模块设计:标准化与定制化的平衡

工具的核心功能模块设计体现了对用户需求的差异化响应。竞品雷达类工具如Crayon主打动态监控,通过AI识别竞品官网改版、定价调整等细微变化,并生成可视化时间轴,适合市场部门实时应对策略调整;而战略分析工具如Kompyte则内置SWOT模板与波特五力模型,自动抓取竞品财报数据生成对比报告,更贴合管理层决策场景。在社交监测领域,Brandwatch与Talkwalker均支持多平台舆情分析,但前者提供情绪识别的机器学习模型,能区分讽刺性评论,后者则强化了图片与视频内容的OCR解析能力。值得注意的是,部分工具如SpyFu通过历史广告库回溯功能,可查看竞品15年来的广告文案演变,而SEMrush的Ad History工具仅保留近3年数据,这种差异决定了长期战略研究与短期战术优化的工具选择边界。

3. . 输出形式与协作效率:从数据到决策的转化速度

最终报告的呈现形式直接影响团队协作效率。Tableau集成的竞品分析插件支持自定义仪表盘,用户可拖拽生成交互式图表,但需要一定的数据处理能力;相较之下,Google Data Studio模板库提供开箱即用的竞品流量对比看板,对非技术人员更友好。在协作场景中,Figma插件Competitive Analysis允许设计团队直接标注竞品UI组件库,而Confluence插件Marketplace Report则能自动同步竞品动态至项目文档。部分工具如BuzzSumo强化了内容营销导向,输出报告直接筛选高互动率竞品内容并推荐传播渠道,而Meltwater的AI摘要功能可将万字分析报告压缩为三段式要点,显著提升信息传递效率。对于跨国团队,多语言支持成为隐性门槛,Semrush提供43种语言界面与本地化关键词库,而Similarweb的免费版仅支持英语和日语,这种细节差异往往被忽视却直接影响实际使用体验。

十、数据可视化与报表生成能力评测

1. 可视化设计原则与工具适配性评测

数据可视化的核心价值在于通过图形化手段降低信息解读成本,因此评测需重点考察设计原则的落地能力。首先,评估视觉编码的准确性,包括是否根据数据类型(连续/离散、时序/分类)选择合适的图表类型,例如用折线图展示趋势、热力图呈现密度分布,避免误用饼图表达非比例关系。其次,测试视觉元素的规范性,如坐标轴刻度的合理性、色彩搭配的辨识度(色盲友好设计)、标签与图注的完整度,以及交互设计(钻取、筛选、联动)是否符合用户认知逻辑。工具适配性方面,需考察候选人对主流工具(如Tableau、Power BI、Python Matplotlib/Seaborn、ECharts等)的掌握深度,包括是否能在多工具间灵活切换、根据需求场景(静态报表/动态大屏/嵌入式分析)选择最优方案,以及能否通过自定义组件突破工具功能限制。

2. 动态报表与自动化流程实现能力评测

现代报表系统需满足数据实时性与更新自动化的需求,评测需聚焦技术实现与效率优化。动态报表能力体现在数据源对接的广度与深度,包括是否支持多源异构数据(数据库、API、Excel、日志文件)的集成,能否通过参数化控件实现用户自定义查询维度(如时间范围、区域筛选),以及是否具备增量更新与缓存机制以平衡性能与实时性。自动化流程评测则需考察端到端的设计能力,例如:能否通过ETL工具(如Apache Airflow、Kettle)或脚本(Python Schedule、R任务调度)构建数据抽取-清洗-聚合-输出的流水线;是否设置异常监控与告警机制(如数据质量校验、邮件通知);以及报表生成后能否自动化分发(邮件推送、FTP上传、API接口对接)并留存版本日志。此外,需评估候选人对报表模板复用、权限控制(行/列级数据脱敏)等企业级需求的处理能力。

3. 业务场景适配性与决策支持价值评测

可视化与报表的最终目标是驱动业务决策,评测需结合实际场景验证其业务转化价值。首先,考察需求理解能力,包括能否拆解业务指标(如用户留存率、库存周转率)为可量化数据维度,是否主动识别潜在的数据分析盲点(如异常波动归因、多指标关联分析)。其次,评估报表的决策导向性,例如是否通过对比分析(同比/环比、竞品对标)、预测模型(趋势线、回归分析)等提供可行动洞察,而非简单罗列数据。针对不同角色(管理层/运营/技术),评测其报表分层设计能力,如管理层关注核心KPI看板,运营需细粒度操作数据,技术团队重视系统性能指标。最后,通过模拟业务问题(如“如何优化营销ROI”)考察候选人能否快速定位数据关键点,并通过可视化呈现清晰的结论路径,体现数据赋能业务的闭环能力。

十一、客户支持与培训资源对比

1. 响应效率与专业性

在客户支持的响应效率层面,两者存在显著差异。平台A建立了7x24小时的全天候在线支持体系,通过AI智能机器人优先处理高频问题,实现30秒内的初步响应,复杂问题则无缝流转至技术支持团队。其支持团队由具备行业认证的技术专家组成,能提供深度技术咨询与故障排查,平均问题解决周期控制在4小时以内。平台B则采用工作日9-18小时的工单支持模式,响应时间波动较大,简单问题需1-2小时,复杂故障可能跨日处理。其支持团队以基础客服为主,技术问题常需二次转接,专业深度明显不足,且缺乏紧急情况下的绿色通道,对企业级用户的服务连续性构成潜在风险。这种差异直接影响用户问题解决的时效性,尤其在关键业务场景中,平台A的高效响应能有效降低运营中断损失。

2. 培训资源的深度与形式

培训资源的设计直接关系到用户对系统的掌握程度与使用效率。平台A构建了体系化的学习生态,涵盖从入门指南到高级开发的完整课程链。其资源形式包括:1)结构化视频教程(约200+课时),支持倍速播放与字幕检索;2)互动式沙箱环境,用户可实时模拟操作场景;3)每月定期举办的在线研讨会,由产品经理深度解读新功能与行业案例;4)针对企业用户的定制化培训服务,可根据业务流程设计专属课程。平台B的培训资源相对单薄,主要依赖静态文档与基础操作视频(约50+课时),缺乏实践环境与进阶内容。其文档更新滞后于版本迭代,部分功能说明仍停留在旧版本,且无针对管理员或开发者的专项培训,导致用户难以充分发挥系统潜力。这种资源深度与形式的差距,使得平台A用户能更快实现从基础应用到深度定制的跨越。

3. 知识库与社区生态

知识库与社区生态是衡量支持体系成熟度的关键指标。平台A的知识库采用智能分类与语义搜索技术,用户可通过关键词、场景或错误代码快速定位解决方案,文档包含详细步骤说明、截图及常见错误规避提示,准确率达92%。其官方社区聚合了超万名活跃用户,形成问题互助与经验分享的良性循环,技术团队每周固定参与答疑,并精选优质内容纳入知识库。平台B的知识库为传统的树状目录结构,检索功能仅支持标题匹配,文档内容多为功能罗列,缺乏场景化指引,用户常需反复查阅多份文档才能解决问题。社区处于起步阶段,月活用户不足千人,回复质量参差不齐,且官方参与度低,难以形成有效的知识沉淀。这种生态系统的完善度差异,使得平台A用户不仅能获得官方支持,还能通过社区获得更广泛的实践智慧,长期来看将显著降低用户的使用门槛与支持成本。

十二、多平台卖家选品资源整合方案建议

在多平台运营模式下,选品不再是孤立的灵感迸发,而是一项需要系统化、数据驱动的战略工程。为避免资源浪费与品类冲突,卖家必须构建一套高效的资源整合方案,实现跨平台协同与效益最大化。

1. 构建数据中台,实现跨平台信息聚合

多平台运营的核心痛点在于数据孤岛。亚马逊的销售数据、eBay的趋势指标、独立站的用户行为,若各自为政,将极大削弱决策效率。因此,首要任务是构建一个统一的“数据中台”。该中台需整合三大核心维度的信息:一是内部销售数据,包括各平台的实时销量、转化率、客单价及退货率,形成动态商品生命周期评估;二是外部市场数据,通过爬虫或API接口,抓取各平台热销榜、新品榜、关键词搜索量及平台官方趋势报告,快速捕捉市场新机会;三是供应链数据,对接供应商系统,实时监控库存水平、采购成本与生产周期。通过将这三类数据可视化呈现,卖家能清晰识别出哪些产品具备跨平台普适性,哪些产品仅适用于特定平台,从而为差异化选品奠定坚实基础,避免在错误的平台推广错误的产品。

2. 实施差异化选品矩阵,规避内部竞争与同质化

单纯的数据聚合只是基础,关键在于如何利用数据进行策略性布局。建议根据产品属性与平台特性,建立“差异化选品矩阵”。该矩阵可将产品分为三类:第一类是“核心引流款”,选择市场认知度高、需求稳定的标准品,在Amazon等主流平台以规模效应抢占市场份额,作为品牌基石;第二类是“垂直高利润款”,针对Etsy、独立站等注重社群与个性化的平台,开发设计独特、附加值高的产品,避开红海价格战,提升品牌形象与利润空间;第三类是“趋势测试款”,利用TikTok Shop等新兴渠道的流量红利,快速测试小众或新奇产品,以低成本验证市场反馈,成功后再考虑是否引入其他平台。这种矩阵式管理,既能形成产品梯队,又能明确各平台的运营目标,有效防止自家产品在不同平台间形成内耗,实现“1+1>2”的协同效应。

3. 建立闭环反馈机制,驱动产品迭代与创新

资源整合的最终目的是驱动持续增长。为此,必须建立一个从市场到研发的闭环反馈机制。所有平台的用户评论、客服咨询及社交媒体讨论,都应被系统性地收集并纳入数据中台。通过自然语言处理技术,对海量非结构化文本进行情感分析和关键词提取,精准定位用户痛点与改良建议。例如,若发现多个平台用户普遍反映某款产品的包装易损,或期待新配色,这些信息应直接同步给产品团队,形成快速迭代的任务清单。这种机制将选品从一个静态行为转变为一个动态优化的过程,确保产品开发始终紧贴市场需求,最终构建起以数据为驱动、以用户为中心的可持续选品生态系统。