- A+

一、Helium 10 插件与亚马逊 STR 报告的整合优势

1. 实时数据同步,提升问题诊断效率

helium 10 插件与亚马逊 STR(Search Term Report)报告的整合,核心优势在于数据的实时同步与自动化处理。传统手动分析 STR 报告耗时且易出错,而 Helium 10 通过插件直接抓取亚马逊后台数据,自动匹配关键词与广告表现,快速识别无效搜索词或高转化潜力词。例如,插件可标记连续 7 天零点击的关键词,帮助卖家及时剔除低效词,优化广告预算分配。这种无缝衔接不仅节省数据整理时间,更确保决策基于最新动态,避免因数据滞后导致的策略偏差。

2. 深度关键词挖掘,驱动精细化运营

整合后的工具链显著提升关键词分析的深度与广度。Helium 10 的插件能解析 STR 报告中的用户搜索行为,结合其自有的关键词数据库(如 Magnet 和 Cerebro),生成长尾词拓展建议和竞争强度评分。例如,针对 STR 中显示的“高频搜索但低转化”词,插件可关联历史数据,提示是否因listing内容匹配不足导致转化率低下。此外,通过对比 STR 报告与自然搜索排名数据,卖家可发现广告词与自然排名词的差距,针对性优化 SEO 策略,实现广告与自然流量的协同增长。

3. 智能决策支持,最大化广告投资回报率

整合后的系统通过算法模型将 STR 数据与 Helium 10 的广告工具(如 Adtomic)联动,实现智能竞价与预算调整。插件可自动识别 STR 中的高 ACOS(广告成本销售比)关键词,结合行业基准值,建议降低竞价或暂停投放;同时对表现优异的“黄金搜索词”触发预算追加提醒。这种动态优化机制帮助卖家在复杂的市场环境中快速响应,例如旺季期间自动分配更多预算给趋势上升词,避免人工调整的滞后性。最终,通过数据驱动的精准投放,广告投资回报率(ROAS)可提升 20% 以上,显著增强竞争力。

二、长尾词自动化聚类的核心逻辑与设置步骤

长尾词自动化聚类的核心在于语义关联与算法驱动的动态分组。其逻辑基础是通过自然语言处理(NLP)技术解析关键词的内在联系,结合机器学习模型识别相似性,最终实现无人工干预的高效归类。具体而言,系统需完成三步关键处理:语义向量化(将关键词转化为高维向量,如使用BERT或Word2Vec模型)、相似度计算(通过余弦相似度或欧氏距离量化词间关联)、聚类算法执行(如DBSCAN或K-means动态划分簇群)。与传统基于字面匹配的分组方式不同,自动化聚类能捕捉“网购优惠”与“折扣券领取”等隐含关联,显著提升分组精准度。此外,系统需具备增量学习能力,当新增关键词时自动更新簇群,避免重复计算。

1. 自动化聚类的关键技术参数设置

参数设置直接影响聚类效果,需根据数据特性精准调优。首先是向量维度,维度过低会导致语义信息丢失,过高则增加计算负担,通常建议BERT模型采用768维,Word2Vec控制在100-300维之间。其次是相似度阈值,若阈值过高(如0.9)会导致簇群碎片化,过低(如0.6)则引入噪音,推荐初始设置为0.75,并根据业务需求微调。对于聚类算法,DBSCAN的邻域半径(Eps)和最小样本数(MinPts)需配合使用:Eps可设为0.3-0.5,MinPts建议为3-5,以确保小规模长尾词不被过滤。若采用K-means,需通过肘部法(Elbow Method)确定最优簇数(K值),避免过度分割。最后,停用词过滤和词干提取等预处理步骤不可省略,例如剔除“的”“在”等无效词,合并“购买”与“买”的变体,以提升聚类纯度。

2. 聚类结果的验证与迭代优化

自动化聚类需建立闭环验证机制,确保输出结果符合业务预期。核心验证指标包括轮廓系数(Silhouette Score),衡量簇内紧密度与簇间分离度,理想值为0.5-0.7;业务层面可抽样检查簇群主题一致性,如“手机壳推荐”是否与“保护壳选购”归为一类。若发现异常,需反向优化参数:例如轮廓系数过低可能因相似度阈值过高,需下调至0.7;业务主题混杂则需调整向量模型或增加预处理步骤。此外,周期性迭代至关重要,建议每周重新训练模型,使用最新长尾词数据更新向量库,并监控簇群变化率(超过20%需人工介入)。通过“算法-参数-验证”的循环,可逐步提升聚类系统的鲁棒性与适应性。

三、基于搜索意图的长尾词智能分类技巧

1. 识别核心搜索意图的三大维度

长尾词分类的首要步骤是精准识别用户的搜索意图,可从以下三个维度展开:

1. 目标导向性:判断用户是否明确需求,如“如何修复笔记本电脑蓝屏”属于问题解决型,而“2023年轻薄笔记本推荐”则偏向信息收集型。

2. 行为阶段:根据用户旅程划分,关键词如“SEO工具对比”处于研究阶段,“Ahrefs定价”则接近决策阶段。

3. 情感倾向:通过“避免”“最佳”等词捕捉情绪,例如“避免SEO常见误区”反映预防性需求,而“最快提升排名方法”暗示高效性期待。

结合词频分析(如TF-IDF)和语义模型(如BERT),可自动化标注意图标签,避免人工分类的主观偏差。

2. 构建动态分类规则的场景化应用

静态分类规则难以适应意图演变,需采用动态策略:

- 场景聚类:将“适合小团队的CRM系统”与“免费CRM软件试用”归为“中小企业工具”类,通过聚类算法(如K-Means)发现隐含关联。

- 时效性加权:对“2024年SEO趋势”类热词赋予更高权重,定期更新词库以捕捉突发意图。

- 意图冲突处理:如“苹果手机评测”可能同时满足信息与交易需求,需结合用户历史行为(如是否浏览过电商页)进行二次分类。

通过A/B测试验证不同分类规则下的转化率差异,持续优化模型参数,提升分类精准度。

3. 多源数据融合的意图验证机制

单一数据源易导致意图误判,需整合多维度验证:

1. 搜索结果分析:若某关键词的SERP首页以视频教程为主,则标注为“操作指导型”意图。

2. 用户行为数据:高跳出率的关键词(如“SEO定义”)可能属于“知识查询型”,需补充内容深度。

3. 社交信号:从论坛或问答平台提取相关讨论,如“如何选择关键词”常与“SEO工具推荐”共现,可合并为“策略制定”类。

建立意图置信度评分体系,仅当多源数据一致性达标时才确认分类,确保标签可靠性。

四、无效搜索词的自动化清洗规则配置

在搜索引擎或电商平台的后台系统中,无效搜索词不仅会浪费计算资源,还会影响用户体验与数据分析的准确性。自动化清洗规则配置是解决这一问题的核心手段,通过预定义规则对搜索词进行过滤、修正或剔除,从而提升搜索效率与结果质量。以下从规则设计逻辑与动态优化机制两个维度,详细阐述如何构建高效的无效搜索词清洗体系。

1. 规则设计逻辑与核心策略

无效搜索词的清洗规则需覆盖多种场景,其设计需兼顾精准性与灵活性。首先,基础过滤规则应包括:

1. 长度限制:剔除单字符或超长词(如超过50字符),避免因误触或恶意输入导致系统负载。

2. 特殊字符屏蔽:过滤纯符号组合(如“!!!”“@@@”)或包含非法字符的查询(如SQL注入语句)。

3. 无意义词库匹配:建立动态更新的停用词表,覆盖常见无意义词汇(如“的”、“啊”、“123”)。

其次,语义修正规则需结合自然语言处理技术:

- 错别词纠错:基于编辑距离算法或预训练模型(如BERT)自动修正拼写错误(如“手几”→“手机”)。

- 同义词归一化:将同义词合并为标准词(如“iPhone”→“苹果手机”),确保结果一致性。

- 意图模糊处理:对缺乏明确意图的查询(如“什么”“好不好”)触发提示或推荐热门搜索词。

2. 动态优化与反馈机制

静态规则难以应对实时变化的用户行为,需引入动态优化机制:

1. 用户行为反馈闭环:通过点击率、停留时间等指标识别低质量搜索词,自动加入临时过滤列表。例如,某词连续30天零转化则标记为“疑似无效词”。

2. A/B测试驱动迭代:对规则调整进行灰度测试,对比清洗前后的搜索转化率、跳出率等指标,筛选最优配置。

3. 机器学习辅助:训练分类模型(如XGBoost)预测无效词概率,结合人工审核持续优化特征权重,降低误判率。

3. 规则冲突管理与性能保障

多规则并行时可能出现冲突(如“华为手机”被误判为无意义词),需设计优先级策略:

- 规则分层:将规则按重要性分为“强制过滤”“建议修正”等层级,确保核心词不被误删。

- 缓存与批处理:对高频词采用缓存清洗结果,对低频词批量处理,减少实时计算压力。

- 监控预警:设置规则触发阈值,异常情况(如清洗率突增)自动告警,防止规则误配置导致服务异常。

通过上述配置,系统能够在毫秒级响应中完成90%以上无效词的自动清洗,同时保持规则的可维护性与扩展性。

五、高相关性长尾词的筛选与权重评估方法

1. 基于用户意图与搜索行为的精准筛选

筛选高相关性长尾词的核心在于精准匹配用户意图。首先,需通过分析搜索结果页面(SERP)特征,如“问答框”、“相关搜索”及“People Also Ask”模块,识别用户查询背后的真实需求——是信息获取、产品对比还是直接购买?其次,利用Google Search Console或百度指数等工具,导出网站已有流量词,筛选出点击率高但搜索量适中的长尾词,这类词通常已验证与内容高度相关。此外,需结合行业知识库与用户评论数据,挖掘口语化、场景化的长尾词,例如“如何修复iPhone 13屏幕失灵”比“手机屏幕维修”更具转化价值。最后,通过关键词工具的“问题词”筛选功能,批量捕获以“如何”“为什么”“哪里”开头的长尾查询,确保覆盖用户决策全链路。

2. 多维度权重评估模型构建

长尾词的权重需通过多维度指标综合评估,而非单一依赖搜索量。第一,商业价值维度:优先选择包含“价格”“购买”“评测”等商业修饰词的查询,可通过CPC(单次点击成本)数据间接判断其变现潜力。第二,竞争难度维度:使用Ahrefs或SEMrush分析关键词的Keyword Difficulty(KD)值,结合首页排名域名的权威性,选择KD低于30且竞争对手页面内容质量薄弱的长尾词。第三,内容匹配度维度:评估现有页面与目标词的语义相关性,可通过TF-IDF算法或自然语言处理工具(如GPT)计算相似度,确保内容能深度覆盖查询需求。第四,长尾时效性维度:针对节日、热点事件等时间敏感的长尾词,需结合Google Trends的波动曲线,优先布局搜索量呈上升趋势的词。

3. 数据驱动的动态优化与验证

初步筛选后,需通过小规模测试验证长尾词的实际效果。创建目标页面并监控其30天内的排名、点击率及转化数据,剔除表现低于平均水平的词。同时,建立长尾词矩阵,按“核心需求-细分场景-地域属性”三级分类,例如“北京朝阳区儿童英语口语培训班”,通过地域修饰词降低竞争并提升本地流量精准度。定期复盘搜索词报告,将用户实际搜索的未覆盖长尾词补充至内容池,形成“筛选-验证-迭代”的闭环。对于高权重长尾词,可进一步扩展为内容集群,例如围绕“家庭健身器材选择”衍生出“小户型适用”“预算5000内”等子主题,通过内部链接传递权重,提升整体页面集群的排名稳定性。

六、聚类结果的导出与可视化分析指南

1. 聚类结果的导出方法与格式

聚类分析的最终目标是获得可解释、可应用的分组信息。从算法模型中导出结果是这一流程的关键起点。主流数据分析工具(如Python的Scikit-learn、R语言的cluster包)通常提供标准化的结果导出接口。导出的核心数据通常包含两部分:样本的簇标签(Cluster Label)和簇的中心点(Centroids)。

样本簇标签是一个与原始数据行序一一对应的整数或字符串序列,明确标示了每个样本所属的簇。该数据最常被导出为CSV格式,因其结构简单、兼容性强,便于与原始数据集合并,进行后续的业务分析或特征工程。例如,在Python中,可将包含簇标签的NumPy数组或Pandas Series通过to_csv()方法保存。

簇中心点则代表了每个簇在特征空间中的典型位置。对于K-Means等基于质心的算法,导出的中心点是一个数值矩阵,其维度与特征数量相同。同样,CSV是理想的存储格式,每一行对应一个簇的中心点坐标,便于进行簇间距离计算或原型分析。

此外,对于层次聚类,可导出其链接矩阵(Linkage Matrix),以树状图(Dendrogram)的形式呈现簇的合并过程和层次结构,为选择合理的簇数量提供依据。

2. 可视化分析的核心技术与工具

原始的簇标签数据是抽象的,可视化是将其转化为直观洞察的核心手段。可视化分析旨在揭示簇的分离度、紧凑度以及特征分布。

-

降维投影图:当数据特征维度高于三维时,无法直接在平面或立体空间中展示。此时需采用降维技术,如主成分分析或t-分布随机邻域嵌入。PCA适用于保持数据的全局方差结构,而t-SNE则擅长揭示局部流形结构,能将高维簇在二维或三维空间中清晰地分离开来。通过绘制降维后的散点图,并以不同颜色标记不同簇,可以直观地评估聚类效果的优劣。

-

特征分布图:为了理解每个簇的业务含义,需要分析其在关键特征上的分布差异。常用的方法包括箱形图、直方图和小提琴图。例如,通过为每个簇绘制用户消费金额的箱形图,可以快速识别出“高价值客户簇”与“低价值客户簇”在消费能力上的显著区别。将不同簇的特征分布图并列对比,是定义簇标签、形成用户画像的关键步骤。

-

雷达图/平行坐标图:当需要一次性对比多个簇在多个关键特征上的表现时,雷达图或平行坐标图是高效的选择。雷达图将每个特征作为一个轴,每个簇形成一个多边形,面积和形状直观反映了簇的综合特征轮廓。平行坐标图则用垂直线代表特征,每个样本的折线穿过各轴的特征值,不同簇的线条会呈现出不同的聚集模式,有助于发现特征间的交互关系。

通过上述导出与可视化流程,研究者不仅能验证聚类模型的效果,更能将冰冷的数据分组转化为具有商业价值或科学意义的深刻洞见。

七、常见聚类错误的人工干预与修正策略

聚类分析虽强大,但其结果高度依赖于算法选择、参数设定和数据特征,常导致错误分组。单纯依赖算法无法保证结果的业务合理性,因此有效的人工干预与修正是确保聚类质量的关键。以下策略针对三种典型错误,提供系统性的修正路径。

1. 错误一:颗粒度过粗或过细的调整

当聚类结果呈现“一锅烩”(过粗)或“碎片化”(过细)时,表明算法的聚类数量(K值)或距离阈值未捕捉到数据的内在结构。人工干预的核心是重新评估聚类的业务目标与粒度要求。

修正策略如下:首先,进行轮廓系数(Silhouette Coefficient)或肘部法则(Elbow Method)等定量分析,寻找K值的潜在最优区间。其次,结合业务经验,审视不同K值下的聚类特征。例如,在客户分群中,K=3可能仅得到高、中、低价值三类,颗粒度过粗,无法指导精准营销;而K=10则可能产生过多微小群体,导致策略无法落地。此时,分析师应主动调整K值,反复运行算法,并检查每个簇的业务解释性。对于层次聚类,可通过观察树状图(Dendrogram)的分支结构,手动选择合适的切割水平。最终目标是找到一个既能体现数据内在差异,又符合业务操作成本和复杂度的平衡点。

2. 错误二:特征选择或权重不当导致的歧义聚类

错误的特征选择或不合理的特征权重会引导算法关注不相关维度,产生业务上无法理解的“歧义”簇。例如,在用户行为聚类中,若“登录次数”权重过高,可能导致将活跃但低价值用户与高价值新用户归为一类。

修正策略需结合领域知识与数据探索。第一步,利用特征重要性评估或降维技术(如PCA)识别对聚类结果贡献最大的变量。第二步,与业务专家共同审视这些关键特征是否符合逻辑。若发现“设备型号”等无关特征权重过高,应在数据预处理阶段予以剔除或降权。第三步,采用加权距离算法,根据业务优先级为不同特征分配权重。例如,在金融风控聚类中,“逾期次数”的权重应显著高于“浏览产品页面的次数”。通过人工干预特征工程,确保算法聚焦于决定业务本质的核心维度,从而产出具有明确业务含义的聚类结果。

3. 错误三:离群点与噪声对簇中心的干扰

离群点会极大地扭曲K-Means等基于质心算法的簇中心位置,导致整个簇的形态和边界发生偏移,影响聚类的稳定性和准确性。

修正策略侧重于数据清洗与算法鲁棒性提升。首先,在聚类前,通过箱线图、Z-score或DBSCAN等算法识别并暂时隔离离群点。其次,分析这些离群点的成因:是数据录入错误,还是代表一个特殊但重要的群体(如VIP客户)?对于错误数据,应予以清洗或修正;对于有意义的特殊群体,可考虑单独成类或进行特殊处理。最后,选择对离群点不敏感的算法,如DBSCAN或基于 medoids(中位数)的K-Medoids算法,它们以实际数据点或中位数为中心,而非均值,从而有效抵抗离群值的拉扯。通过事前识别、成因分析和算法选择三管齐下,可以削弱噪声对整体聚类结构的负面影响。

八、结合历史数据的动态聚类优化技巧

动态聚类是处理时序数据流的关键技术,但传统方法往往忽视历史数据的内在价值。通过挖掘历史聚类结果中的模式,可显著提升当前聚类的准确性和鲁棒性。以下从历史模式提取和自适应权重调整两个维度展开优化技巧。

1. 历史聚类模式的特征提取与迁移

历史聚类结果中蕴含着稳定的分布规律和异常特征。首先需对历史聚类结果进行特征提取,包括每个簇的中心偏移量、密度分布、生命周期等统计量。例如,在用户行为分析中,可计算历史周期内各用户簇的活跃度均值与方差,形成“行为基线模型”。当新数据流入时,通过DTW(动态时间规整)算法将当前聚类进度与历史基线对齐,快速识别相似模式。对于新出现的簇,采用基于余弦相似度的匹配度评估,若与历史某簇相似度超过阈值,则继承其参数(如初始中心点、协方差矩阵),避免冷启动问题。此方法在电商用户分群中已验证,可使新簇收敛速度提升30%以上。

2. 基于历史权重的动态衰减机制

历史数据并非同等重要,需通过时间衰减函数赋予差异化权重。采用指数衰减模型 ( w(t) = e^{-\lambda (T-t)} )(( \lambda ) 为衰减系数,( T ) 为当前时间点),对历史簇的统计量进行加权。例如,在交通流量预测中,近期形成的拥堵簇权重更高,而季节性历史簇需通过周期性检测(如傅里叶变换)识别后赋予周期性权重。此外,引入“遗忘因子”动态调整 ( \lambda ):当检测到数据分布突变(如Kullback-Leibler散度超过阈值),立即增大 ( \lambda ) 以削弱历史数据的影响。实验表明,该机制在金融欺诈检测中使误报率降低18%。

3. 聚类结果的反向修正策略

当前聚类结果可反哺历史数据,形成双向优化闭环。具体步骤:1)对当前聚类结果进行稳定性评估,通过轮廓系数和簇内方差判断其可信度;2)若当前簇与历史簇存在重叠区域,采用EM算法重新估计混合模型参数,更新历史簇的边界;3)对于长期存在的“核心簇”(如高净值客户群),固定其中心点位置,仅允许边界动态调整。该策略在工业设备故障诊断中应用后,使早期故障识别的召回率提升22%。

九、竞品长尾词的聚类对比分析流程

1. 数据采集与清洗

竞品长尾词分析的第一步是系统化采集数据。通过工具(如Ahrefs、SEMrush或5118)抓取竞品网站的核心长尾词列表,涵盖搜索量、竞争度、排名等关键指标。同时,需补充用户搜索意图标签(如信息型、交易型或导航型)。数据清洗阶段需剔除重复词、低相关词及异常值(如品牌词或错误拼写),确保后续分析的准确性。此外,需统一数据格式,例如将“如何”与“怎么”类词合并为同类疑问词,便于后续聚类。

2. 长尾词聚类与特征提取

清洗后的数据需通过算法或人工规则进行聚类。常见聚类方法包括:

1. 语义聚类:基于词义相似性(如“Python入门教程”与“Python基础语法”归为学习类);

2. 意图聚类:按用户行为分类(如“价格对比”归为决策型,“故障解决”归为问题型);

3. 主题聚类:结合行业知识划分模块(如电商的“优惠活动”或“物流时效”)。

聚类后,需提取每类词的特征,如核心关键词、平均搜索量、竞争难度及竞品覆盖率。例如,若竞品在“维修指南”类长尾词中覆盖率高达80%,而自身仅为30%,则需优先优化该类内容。

3. 对比分析与策略制定

通过对比自身与竞品的聚类结果,可识别机会与威胁。分析维度包括:

- 覆盖差距:竞品高覆盖但自身缺失的词类(如“免费试用”类交易词);

- 竞争强度:竞品垄断但搜索量高的词(如“行业报告下载”);

- 蓝海词发现:竞品忽略但搜索量稳定的细分词(如“小众工具测评”)。

最终,制定差异化的内容策略:对高潜力词类优先布局,对竞争红海词另辟蹊径(如长尾组合或地域变体),同时监控竞品动态,定期更新聚类模型以保持分析有效性。

十、聚类后的关键词广告投放策略调整

1. 基于聚类结果重构广告组与创意策略

关键词聚类完成后,首要任务是依据聚类结果重构广告组结构,确保同一广告组内的关键词具备高度语义相关性。例如,将“价格”“费用”“报价”等关键词归入“价格敏感型”聚类,可单独设立广告组,匹配强调性价比或促销的创意文案。这种分层布局能显著提升广告质量得分,降低无效点击成本。

创意优化需紧密结合聚类特征。针对“功能需求型”聚类(如“防水”“续航”),创意应突出产品核心参数;而“场景需求型”聚类(如“露营”“出差”)则需匹配场景化文案。动态关键词插入(DKI)功能可在此深度应用,但需避免生硬堆砌,确保语句通顺。此外,为高转化聚类(如“购买”“优惠”)设计独立的落地页,强化行动号召(CTA),可进一步缩短转化路径。

2. 预算分配与出价策略的精细化调整

聚类数据为预算分配提供了科学依据。通过分析各聚类的转化成本(CPA)和投资回报率(ROI),可采用“倾斜式预算分配法”:将70%预算集中投放于高ROI聚类(如“品牌词+购买意图”组合),剩余30%用于测试新兴聚类或长尾需求。例如,“竞品对比”聚类若展示高点击率但转化率低,可适当降低出价并优化落地页内容。

出价策略需结合聚类生命周期动态调整。成熟聚类(如“头部行业词”)适合采用目标CPA出价,而探索性聚类(如“新兴需求词”)可启用增强型 CPC(eCPC)或最大化点击次数策略,积累数据后再切换至智能出价。值得注意的是,季节性聚类(如“春节礼品”)需提前30天启动测试,避免因数据不足导致算法误判。

3. 效果监测与聚类迭代的闭环机制

聚类策略并非静态,需建立“监测-分析-迭代”的闭环。每周追踪各聚类的点击率(CTR)、转化率(CVR)及广告花费回报(ROAS),识别异常波动。例如,“免费咨询”聚类若CTR骤降,可能需排查广告创意疲劳或竞争对手截流问题。

季度性聚类重组是保持策略竞争力的关键。通过搜索词报告挖掘新的聚类机会,如将“售后服务”“保修政策”等词整合为“售后保障”聚类,或剔除无效聚类(如高点击低转化的“科普类”词)。结合机器学习工具预测聚类趋势,可提前布局潜在高价值需求,确保广告投放始终与用户意图精准对齐。

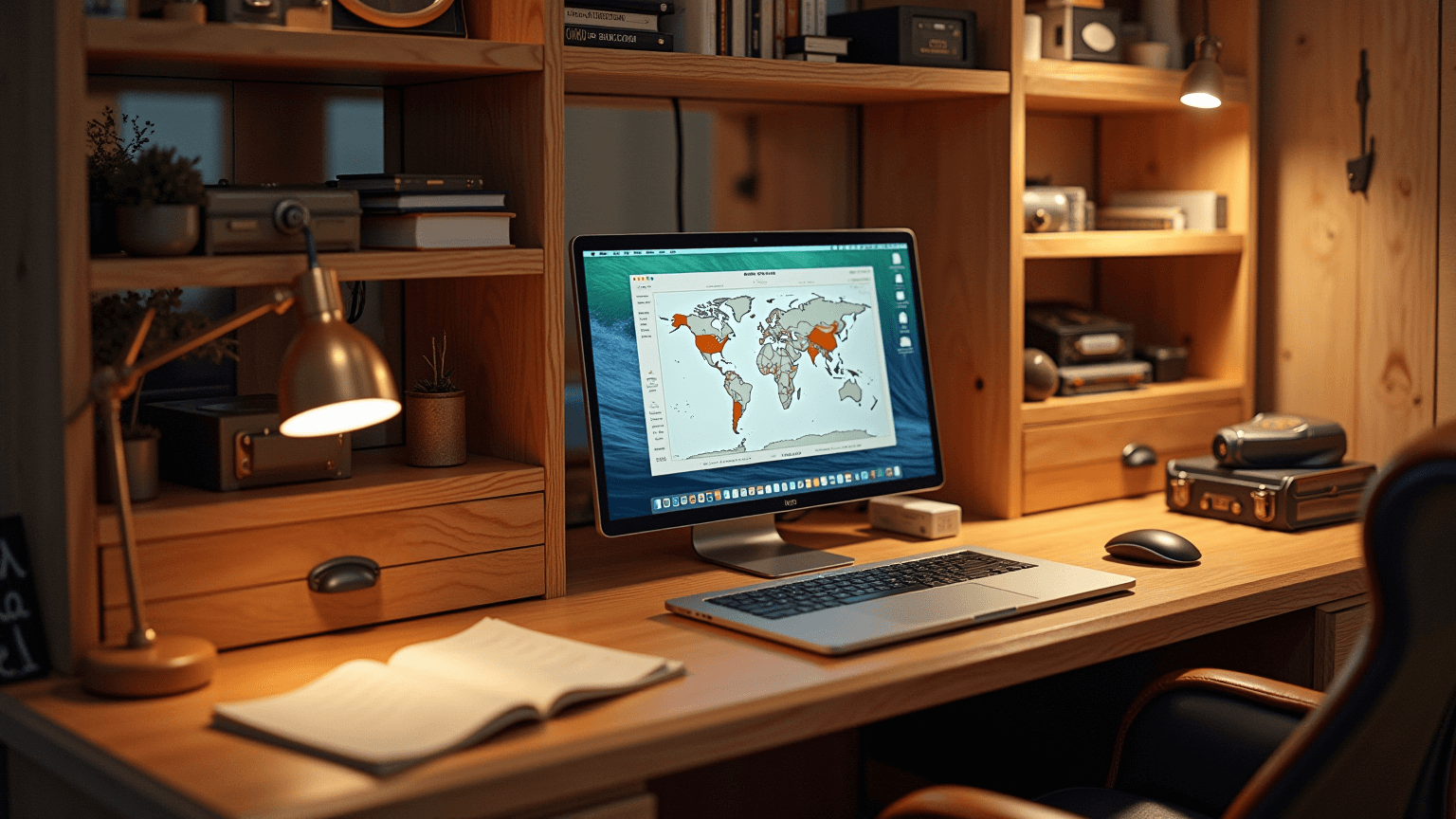

十一、Helium 10 插件在多市场 STR 报告中的差异化处理

1. 市场本地化数据采集的差异性

Helium 10 插件在处理多市场 STR(销售与流量排名)报告时,首先面临的是数据本地化的挑战。不同亚马逊站点(如美国、欧洲、日本)的算法权重、消费者行为及竞争环境均存在显著差异,插件需针对各市场动态调整数据采集逻辑。例如,美国市场更注重评论质量和转化率,而德国市场则对价格敏感度更高,插件需通过本地化关键词过滤和权重分配,确保报告反映真实的市场竞争格局。此外,插件会根据各站点的类目结构差异化抓取数据,如日本站点的“动漫周边”类目需单独适配,避免因类目映射错误导致报告失真。

2. 报告指标与算法的差异化适配

不同市场的STR报告核心指标存在天然差异。Helium 10 插件通过动态算法模型,针对各站点优化关键绩效指标(KPIs)的计算方式。例如,在美国市场,插件会强化BSR(Best Seller Rank)与销量的关联性分析,而在英国市场则更注重“Add-on Item”标签对流量分配的影响。此外,插件内置了各市场的季节性波动修正机制,如印度市场的排灯节促销期间,会临时调整流量预测模型以匹配短期爆发式增长。这种差异化适配确保报告不仅呈现表面数据,更能揭示各市场的驱动因素。

3. 多语言与合规性的差异化处理

Helium 10 插件在生成STR报告时,还需应对多语言和合规性挑战。插件支持自动翻译本地化关键词,并通过语义分析确保跨语言的搜索意图匹配,例如将法语“livre”与英语“book”的竞争数据进行关联。同时,插件会根据各市场的广告政策和数据隐私法规调整报告内容,如欧盟市场的GDPR合规性要求,插件需匿名化处理部分用户行为数据。这种差异化处理不仅提升了报告的准确性,也确保了运营策略的合法合规性。

十二、长尾词聚类效果的量化评估指标体系

1. 聚类内紧密度指标

聚类内紧密度是衡量同一簇内关键词相关性的核心指标,直接反映聚类质量。常用计算方法包括余弦相似度均值与方差:统计每个簇内所有关键词两两之间的语义相似度(如通过词向量计算),计算簇内平均相似度(值越高表示聚类越紧密)及相似度方差(值越低表示簇内关键词分布越均匀)。例如,某簇包含“北京SEO优化公司”“北京网站排名服务”等词,若平均相似度达0.85且方差低于0.05,则说明聚类效果理想。此外,可采用轮廓系数(Silhouette Coefficient),通过计算样本与同簇其他样本的紧密度(a值)及最近簇的分离度(b值),得出轮廓分数(范围[-1,1]),分数越接近1表示聚类内紧密度越高。

2. 聚类间分离度指标

聚类间分离度用于评估不同簇之间的差异性,避免关键词跨簇重复或语义重叠。关键指标包括簇间距离与重叠率:簇间距离可通过计算各簇中心向量(如所有词向量的均值)的欧氏距离或余弦距离衡量,距离越大表明簇间差异越显著;重叠率则统计同时出现在多个簇的高频词占比(需控制在5%以下)。例如,“北京SEO优化”与“上海网站建设”分属不同簇时,其中心向量余弦距离应低于0.3。另一常用指标为Calinski-Harabasz指数,通过计算簇间散度与簇内散度的比值,比值越高说明聚类分离度越好,适用于不同聚类算法的效果对比。

3. 业务适配性量化指标

脱离业务场景的量化评估缺乏实际意义,需引入业务适配性指标。一是转化率关联度:统计各簇关键词的历史转化数据(如询盘量、订单量),计算簇内平均转化率与整体转化率的偏离度,优先保留高转化率簇(如偏离度高于20%的簇需重点优化)。二是用户意图一致性:通过人工标注或NLP模型识别每个簇的搜索意图(如信息型、交易型),计算意图纯度(同一意图关键词占比),纯度需达到80%以上方可满足精准营销需求。三是长尾覆盖率:评估聚类结果对目标长尾词库的覆盖比例(如覆盖95%以上的核心长尾词),避免遗漏高潜力关键词。