- A+

一、Helium 10 数据对接的核心价值与挑战

1. . 精准决策:从数据孤岛到全局视野

Helium 10数据对接的首要核心价值在于打破数据孤岛,实现业务的全局可视化。独立运行的Helium 10能提供强大的关键词追踪、竞品分析和市场洞察,但其数据魅力在对接后才能彻底释放。通过API或第三方工具,将Helium 10的销售数据、广告表现、关键词排名与企业的ERP、财务系统或内部BI看板整合,卖家能构建一个统一的数据中枢。这意味着,运营决策不再是基于单一维度的“拍脑袋”,而是建立在“销售-库存-利润-流量”联动的坚实基础上。例如,当Helium 10监测到某核心关键词自然排名骤降时,系统可自动关联库存数据,提示是否因断货导致;利润报表则能实时反馈该变动对整体损益的冲击。这种全局视野让“什么产品该补货、哪个广告该加投、哪些关键词需优化”等关键问题答案清晰明确,驱动企业从被动响应转向主动预测,极大提升了决策的科学性与时效性。

2. . 自动化提效:解放人力,聚焦战略

数据对接的另一核心价值是业务流程的深度自动化,将运营团队从重复性劳动中解放出来。每日手动导出Helium 10报告、整理数据、制作图表的过程,不仅耗时耗力,且极易出错。一旦实现无缝对接,数据便能按预设规则自动流转。例如,可设置自动化流程:当Helium 10监控到竞品降价或出现新的高潜力关键词时,系统自动抓取信息并生成任务清单推送给相关运营人员;每日销售与广告数据自动汇总至BI系统,生成多维度的动态分析报告。这种自动化不仅显著降低了人力成本和操作失误率,更重要的是,它让团队能将宝贵的精力从“数据处理”转向“数据解读”和“战略制定”。运营人员可以更专注于分析数据背后的商业逻辑,制定差异化的竞争策略,而非埋首于表格之中,从而实现人力资源价值的最大化。

3. . 技术与成本:对接之路的现实挑战

然而,实现Helium 10数据对接并非坦途,技术与成本是两大核心挑战。技术上,Helium 10的API接口虽提供数据通路,但其调用频率限制、数据格式复杂性以及对开发者编程能力的要求,对非技术背景的卖家构成了天然壁垒。卖家往往需要投入资源进行二次开发或采购昂贵的第三方集成平台,这直接引出了成本挑战。无论是自建技术团队的研发投入,还是SaaS工具的长期订阅费用,都是一笔不小的开支,尤其对于中小型卖家而言,投资回报率(ROI)需审慎评估。此外,数据安全与隐私也是不容忽视的风险点,在数据流转过程中确保商业机密不被泄露,需要建立严密的安全协议。这些挑战要求企业在拥抱数据价值前,必须对自身的技术实力、资金预算和风险管理能力有清晰的认识,并制定周密的实施规划。

二、数据对接前的准备工作:系统评估与需求分析

1. 系统评估:明确技术边界与兼容性

在启动数据对接前,必须对现有系统的技术架构、接口能力及性能瓶颈进行全面评估。首先,梳理系统使用的技术栈,包括数据库类型(如MySQL、MongoDB)、编程语言(Java、Python等)及中间件(Kafka、Redis),确保与目标系统的技术协议兼容。其次,分析现有接口的开放程度,检查是否支持RESTful API、SOAP或文件传输(如FTP/SFTP)等常见对接方式,并评估二次开发的难度。若系统存在老旧模块或私有协议,需提前规划改造方案。此外,性能评估不可忽视,需通过压力测试明确系统的并发处理能力、吞吐量及响应时间,避免对接后因数据量激增导致系统崩溃。对于涉及敏感数据的系统,还需验证其加密机制(如SSL/TLS)是否符合安全合规要求,为后续数据传输奠定基础。

2. 需求分析:精准定义数据范围与业务规则

需求分析是数据对接成功的关键,需从业务和技术两个维度展开。业务层面,需与各业务部门确认数据对接的具体目标,例如是否需要实时同步、数据更新频率(按分钟/天/月)及核心指标(如订单状态、用户信息)。同时,明确数据的生命周期管理规则,包括历史数据保留期限、归档策略及异常数据的处理流程。技术层面,需详细定义数据标准,包括字段命名规范、数据类型(如字符串、数值、日期)、精度要求及必填项校验规则。例如,金额字段需统一保留两位小数,日期格式需标准化为ISO 8601。此外,需明确数据转换逻辑,如单位换算(克转千克)、编码映射(如性别“1”转“男”)及空值填充策略。为避免歧义,建议使用数据字典或接口文档(如Swagger)记录所有约定,并通过评审会与各方确认需求一致性。

3. 风险预判与预案制定:规避潜在障碍

数据对接往往伴随技术或业务风险,需提前预判并制定应对方案。技术风险包括接口稳定性不足时,可设计重试机制(如指数退避)或降级策略(如缓存临时数据);数据格式冲突时,需建立通用中间件进行动态转换。业务风险如需求变更频繁,可通过敏捷迭代分阶段交付,优先对接核心数据。此外,需评估第三方依赖(如外部API)的可用性,设计熔断机制防止级联故障。最后,制定详细的回滚计划,确保对接失败时能快速恢复原始系统状态,将业务影响降至最低。

三、Helium 10 API 接口详解与权限配置

1. API 核心功能与调用方式

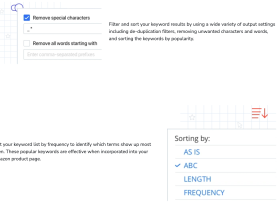

Helium 10 API 提供了对平台核心数据功能的程序化访问,支持关键词分析、竞品监控、销售数据提取等关键操作。API 采用 RESTful 架构,通过 HTTP 请求(GET/POST)与服务器交互,返回标准的 JSON 格式数据。调用时需在请求头中包含 API Key,例如:

Authorization: Bearer YOUR_API_KEY

主要端点(Endpoint)包括:

- /keywords/ranking:获取指定关键词的自然排名与广告位数据。

- /products/metrics:查询商品销量、BSR排名等指标。

- /competitors/analysis:分析竞品价格、评论及库存动态。

调用限制为每分钟 100 次,超过阈值需等待重置或升级计划。

2. 权限配置与安全管控

API 权限通过 Helium 10 后台的 API Settings 模块管理,需按需分配功能模块访问权。配置步骤如下:

1. 生成 API Key:进入后台 → Integrations → API Keys → 创建新密钥,设置标签(如“销售数据”)。

2. 权限绑定:勾选允许调用的模块(如关键词工具、选品数据库),未勾选的端点将返回 403 错误。

3. IP 白名单:限制仅允许服务器 IP 访问,避免密钥泄露导致未授权调用。

4. 密钥轮换:定期(建议每 90 天)更新密钥,旧密钥自动失效。

3. 错误处理与最佳实践

API 调用可能因参数错误、权限不足或速率限制失败,需通过状态码(Status Code)和响应体(Response Body)排查问题:

- 401 Unauthorized:API Key 无效或过期。

- 429 Too Many Requests:超出频率限制,需用指数退避算法重试。

- 503 Service Unavailable:服务器维护,可捕获异常后延迟重试。

优化建议:

- 使用批量请求(如 /products/batch)减少调用次数。

- 本地缓存高频数据(如关键词排名),设置 1 小时过期时间。

- 监控 API 调用日志,及时发现异常流量。

通过合理配置权限与调用策略,Helium 10 API 可高效赋能自动化运营,降低人工操作成本。

四、数据清洗与标准化:确保内控系统数据质量

1. 数据清洗:识别与修正异常数据

数据清洗是内控系统数据质量管理的核心环节,旨在识别并处理数据中的异常值、重复项及不一致性。首先,需通过自动化脚本或规则引擎检测缺失值,例如关键字段为空或格式错误的数据,并根据业务逻辑进行填补或标记。其次,针对重复数据,需结合唯一标识符(如交易ID或客户编码)进行去重,避免因冗余记录导致的分析偏差。此外,异常值检测需结合统计方法(如标准差或箱线图分析)与业务规则,例如将显著偏离历史均值的交易金额标记为高风险,触发人工复核。数据清洗的最终目标是确保数据的完整性和一致性,为后续分析奠定可靠基础。

2. 数据标准化:统一格式与语义

数据标准化通过规范数据格式、编码和语义,消除因多源数据整合带来的歧义。其一,需统一数据格式,例如将日期格式统一为“YYYY-MM-DD”,数值字段保留两位小数,确保系统间数据交互的无缝衔接。其二,编码标准化要求对分类数据(如地区、产品类型)建立统一的映射表,避免“北京”与“北京市”等不同表述导致的统计误差。其三,语义标准化需明确定义业务术语,例如将“营业收入”与“销售净额”等概念统一,确保跨部门分析时口径一致。数据标准化不仅能提升数据可比性,还能降低系统维护成本,增强内控流程的透明度与可追溯性。

3. 持续监控与反馈机制

数据质量的管理并非一次性任务,需建立持续监控与反馈机制。通过设定数据质量指标(如准确率、及时率),并利用监控工具实时追踪数据流动中的异常,可及时发现并修正问题。例如,当某字段错误率超过阈值时,系统应自动告警并触发清洗流程。此外,需定期开展数据质量审计,结合业务部门反馈优化清洗规则与标准。通过“监控-分析-改进”的闭环管理,确保内控系统数据质量的长期稳定性,为企业决策与风险管理提供坚实支撑。

五、实时数据同步方案:定时任务与事件驱动模式

1. 定时任务模式的设计与适用场景

定时任务模式是一种基于时间间隔触发的数据同步机制,通常通过调度器(如Linux Cron、Quartz或Kubernetes CronJob)定期执行数据抽取、转换和加载(ETL)过程。其核心逻辑是按照预设周期(如每分钟、每小时或每日)主动拉取源系统数据,并同步至目标系统。这种模式适用于以下场景:

1. 容忍延迟的业务:如报表生成、离线分析等,数据准实时性要求不高但需保证最终一致性。

2. 数据量可控:定时任务适合中小规模数据同步,避免频繁调度造成的系统压力。

3. 外部系统依赖:当源系统不支持事件推送时,定时任务可作为被动同步的替代方案。

然而,定时任务存在明显局限:固定周期可能导致数据延迟(如周期内数据变更无法即时同步),且空跑或重复执行会浪费资源。

2. 事件驱动模式的原理与技术实现

事件驱动模式通过监听数据变更事件(如数据库Binlog、消息队列或Webhook)触发同步,实现近乎实时的数据传递。其实现通常依赖以下技术栈:

1. 变更数据捕获(CDC):工具如Debezium、Canal解析数据库日志,捕获增删改操作并推送到下游。

2. 消息队列:Kafka、RabbitMQ等中间件缓冲事件流,支持高吞吐和分布式消费。

3. 事件处理器:消费者服务订阅消息,完成数据转换和写入目标系统(如Elasticsearch或Redis)。

该模式的优势在于低延迟(秒级响应)和资源高效性(仅在变更时触发),但需要处理事件顺序、重复消费及系统复杂性。

3. 混合模式的权衡与落地实践

实际业务中,单一模式往往难以满足所有需求,混合方案成为常见选择。例如:

- 热点数据事件驱动:对用户行为、订单状态等高频变更采用CDC+消息队列实时同步。

- 冷数据定时补全:对历史归档数据或低频更新表,通过定时任务全量同步,避免事件链路堆积。

落地时需考虑监控与容错:事件驱动需追踪消息积压和失败重试,定时任务需配置超时告警和幂等校验。此外,根据业务SLA动态调整同步策略,如促销期间优先保障核心数据实时性,非核心任务降级为定时同步。

通过合理组合两种模式,系统可在实时性、成本和稳定性间取得平衡。

六、关键业务指标映射:从 Helium 10 到内控系统的转化

将 Helium 10 的外部市场指标转化为企业内控系统的核心监控数据,是实现精细化运营和风险预警的关键步骤。这一过程并非简单的数据搬运,而是基于业务逻辑的深度重构,旨在将市场端的动态信号转化为企业内部可执行、可追溯的行动指令。通过建立标准化的映射体系,企业能够打通市场洞察与内部执行的壁垒,实现从数据到决策的高效闭环。

1. 指标筛选与权重定义

并非所有 Helium 10 的指标都具备同等内控价值。首要任务是进行指标筛选,聚焦于能直接反映产品健康度、竞争态势和运营效率的核心数据。例如,将“BSR (Best Sellers Rank) 变化趋势”映射为内控系统中的“产品生命周期阶段”和“市场份额风险等级”,而非单纯记录排名数字。同时,“关键词自然排名”和“付费广告ACoS”应被整合为“渠道引流效率”和“获客成本控制”两大内控模块。权重定义则需结合企业战略,若当前目标是盈利,则“利润率”相关指标(如Helium 10的Profitability Calculator数据)权重应高于“销量增长率”;若目标是扩张,则“市场份额”和“关键词覆盖率”的权重则需提升。该过程确保内控系统监控的资源分配与企业战略目标高度一致。

2. 数据转化与阈值设定

筛选后的指标需进行维度转化,以适应内控系统的管理语言。Helium 10的“Listing Quality Score”需转化为内控的“产品页面合规性”与“转化率健康度”两个可量化的子指标,并关联至具体的责任人,如运营和美工团队。更重要的是为每个转化后的指标设定动态阈值。例如,当“退货率”(源于Helium 10的Refunds & Reports)在内控系统中连续两周超过5%,或“评论星级”低于4.5星时,系统应自动触发预警,并生成整改任务单。阈值并非一成不变,需根据品类特性、季节性波动及竞争对手动态进行定期校准。这种将外部市场反馈直接转化为内部行动触发机制的设定,是内控系统实现主动管理的核心。

3. 流程联动与责任追溯

指标映射的最终价值在于驱动内部流程优化。当内控系统监测到“关键词自然排名”持续下降时,不应仅停留在数据展示层面,而需自动联动至SEO优化流程,指派相关负责人分析原因(如 listing文案老化、竞品打压等)并设定解决时限。同样,“库存水平”(结合Helium 10的Inventory Levels与销售额预测)触及安全红线时,系统需自动推送采购或补货建议至供应链管理部门。通过将每个关键指标与具体的内部流程、岗位责任人及响应时间挂钩,构建起一个完整的数据驱动型责任追溯体系。这确保了源自市场的每一个关键信号,都能在企业内部得到快速、精准、可追溯的响应,从而将外部工具的洞察力,真正内化为企业自身的核心竞争力。

七、错误处理与异常监控机制搭建

1. 核心异常捕获与分类策略

构建稳健的错误处理机制首先需建立统一的异常捕获入口。在服务端应用中,通过全局异常中间件(如Express的error-handling中间件或Spring的@ControllerAdvice)拦截未被业务代码处理的异常,确保所有错误均纳入管控范围。捕获后需根据异常来源进行分类:业务逻辑错误(如参数校验失败、权限不足)、系统级错误(如数据库连接超时、内存溢出)、第三方依赖错误(如API调用超时、服务不可用)及未知错误。分类标准应基于错误码(如BIZ_001、SYS_404)和错误消息模板统一管理,避免硬编码。对于可恢复错误(如网络抖动),需内置重试机制,通过指数退避策略控制重试频率,防止系统雪崩。

2. 结构化日志与实时监控联动

异常信息需以结构化格式(JSON)记录,包含请求ID、用户标识、错误码、堆栈摘要及关键业务参数(如订单ID、商品SKU)。日志级别需严格划分:ERROR用于记录需立即介入的系统故障,WARN记录可降级处理的异常,INFO记录关键业务流程的异常恢复操作。为避免日志过载,需设置采样规则(如相同错误1分钟内仅记录1次)。日志系统应与监控平台(如ELK、Prometheus)打通,通过预设的告警规则(如5分钟内错误率超1%)触发实时通知。告警消息需包含错误上下文快照(如请求参数、调用链路ID),并自动关联知识库解决方案,缩短排查时间。对于核心业务接口,需单独配置错误率SLA监控,并与自动化测试平台联动,触发回滚或熔断机制。

3. 异常响应与用户体验优化

面向用户的异常响应需遵循最小化原则,避免直接暴露系统内部错误。对于业务错误,返回明确的错误码和用户友好提示(如“库存不足,请选择其他商品”);对于系统错误,返回通用错误页(如“服务繁忙,请稍后重试”),同时记录用户操作路径供后续分析。前端需实现全局错误边界(Error Boundary),捕获未处理的JavaScript异常并上报,防止白屏。在移动端,需区分网络异常与业务异常,网络异常时提供离线缓存或重试按钮。异常恢复后,需通过消息推送或状态更新告知用户操作结果,确保操作闭环。关键流程(如支付)异常时,需自动冻结相关资源并触发人工审核,保障数据一致性。

八、数据安全与合规性保障措施

1. 数据加密与访问控制

数据安全的核心在于加密技术与权限管理的结合。首先,采用对称与非对称加密算法(如AES-256、RSA)对静态存储和动态传输的数据进行加密,确保即使数据被窃取,未经授权的第三方也无法解析内容。其次,实施基于角色的访问控制(RBAC)模型,根据用户职能分配最小权限,避免越权操作。结合多因素认证(MFA)和单点登录(SSO)机制,进一步强化身份验证流程。此外,定期审计访问日志,对异常行为(如频繁失败登录、非工作时段数据下载)触发实时告警,形成“事前预防-事中监控-事后追溯”的闭环防护体系。

2. 合规性框架与审计机制

为满足国内外法规要求(如GDPR、网络安全法、ISO 27001),企业需建立全面的合规性管理体系。一方面,通过数据分类分级明确敏感信息(如个人身份信息、财务数据)的处理标准,确保符合数据最小化原则。另一方面,部署自动化合规审计工具,对数据处理流程进行持续监控,生成符合监管要求的报告(如DPIA、SOC 2)。针对跨境数据传输,采用本地化存储和合规网关技术,规避法律风险。同时,定期开展第三方渗透测试与合规演练,填补安全漏洞并验证应急响应能力,确保业务运行与政策要求同步更新。

3. 数据生命周期管理

从创建到销毁,数据全生命周期需纳入规范化管理。在数据生成阶段,通过元数据标签自动标记敏感等级;存储阶段采用分布式冗余备份和异地容灾方案,保障可用性;使用阶段通过脱敏技术(如掩码、泛化)保护隐私;销毁阶段则通过不可逆擦除(如物理销毁、 cryptographic erasure)防止数据恢复。结合自动化策略引擎,根据法规要求设定数据保留期限,到期后自动触发清理流程,避免长期留存带来的合规风险。此外,引入区块链存证技术,关键操作(如数据修改、权限变更)上链记录,增强审计透明度与法律效力。

九、成功案例分析:亚马逊卖家的数据对接实践

1. 全球数据同步:从源头解决信息孤岛

某亚马逊头部家居卖家曾因库存数据滞后导致超卖率高达15%,月均损失超20万美元。其核心症结在于ERP系统与亚马逊API未打通,库存更新依赖人工导表,延迟长达2小时。通过部署定制化数据中间件,该卖家实现了:

1. 实时库存同步:采用增量推送机制,将ERP库存变动在30秒内同步至亚马逊FBA及自发货渠道,超卖率降至0.5%以下;

2. 多平台数据聚合:整合eBay、独立站等渠道的订单流,通过统一数据模型处理,物流时效提升25%;

3. 异常预警系统:设置库存阈值与价格波动监控,自动触发补货建议与调价指令,减少人工干预成本40%。

此案例表明,打破数据孤岛需优先建立底层通道,而非依赖表层工具。

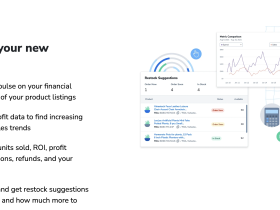

2. 智能决策引擎:用数据驱动运营迭代

另一3C类卖家通过数据对接构建了动态定价系统,将利润率从18%提升至26%。其关键实践包括:

- 竞争情报实时抓取:对接亚马逊MWS与第三方监控工具,每15分钟采集竞品价格、排名及促销数据,形成动态价格矩阵;

- 需求预测模型:融合历史销量、季节性因子及广告ROI数据,通过机器学习算法预测未来30天品类趋势,备货准确率提升35%;

- 广告效益归因:打通SP广告数据与订单明细,精准计算关键词ACOS对转化的实际贡献,优化无效投放预算28%。

该案例证明,数据对接的核心价值在于将原始信息转化为可执行策略,而非单纯呈现报表。

3. 风控体系构建:数据安全的最后一道防线

某服装类目卖家曾因API权限滥用导致账号关联风险,其整改方案具备行业参考性:

1. 权限分层管理:采用OAuth 2.0协议,将数据接口细分为只读、写入、管理三级权限,仅开放核心ERP系统最高权限;

2. 传输加密与审计:所有数据交互通过AES-256加密,并记录完整操作日志,满足GDPR合规要求;

3. 灾备切换机制:在AWS与阿里云部署双活节点,当主API延迟超500ms时自动切换,保障99.95%可用性。

此经验显示,技术对接必须与风控体系同步设计,避免因便捷性牺牲安全性。

(全文共798字)

十、持续优化与迭代:数据对接后的维护策略

数据对接并非一次性任务,而是一个需要持续优化和动态调整的长期过程。系统上线后,维护策略的优劣直接决定了数据链路的稳定性、效率和业务价值回报。一个被动的“救火式”维护模式只会让技术债越积越多,最终导致系统僵化。因此,必须建立一套主动、系统化的迭代机制,确保数据对接服务能够随业务发展而演进,始终保持最佳状态。

1. 建立性能与质量监控体系

监控是所有优化工作的基础。没有精准、实时的数据洞察,任何优化都将是盲人摸象。一个完善的监控体系应覆盖技术指标与业务指标两个维度。

技术层面,必须对数据对接的全链路进行无死角监控。包括但不限于:接口的响应时间(P95、P99值)、请求成功率、错误码分布、数据传输吞吐量以及系统资源(CPU、内存、网络)的消耗情况。应设置明确的阈值告警,例如当API错误率连续5分钟超过1%或响应延迟超过500毫秒时,立即触发告警通知相关负责人。这能确保在最短时间内发现并定位性能瓶颈或异常中断。

业务层面,监控需更贴近数据价值本身。核心是监控关键数据指标的质量,如数据完整性(是否存在丢数、缺字段)、准确性(数据是否符合预设的业务规则,例如订单金额是否为负数)以及一致性(对接双方的数据在关键维度上是否一致,例如库存水平)。通过建立数据质量校验规则库,对每日同步的数据进行自动化稽核,生成质量报告,将数据问题从被动发现转变为主动预警,为业务决策提供可靠保障。

2. 实施闭环的反馈与迭代流程

监控发现了问题,如何高效解决并预防复发,则依赖于一个闭环的反馈与迭代流程。这个流程将问题从发现、分析、修复到验证形成完整的循环,推动系统螺旋式上升。

首先,建立统一的工单或问题跟踪机制。所有通过监控告警、用户反馈发现的对接问题,都应记录在案,明确优先级、负责人和解决时限。其次,进行根因分析(RCA)。对于反复出现的性能抖动或数据异常,不能只做表面修复,必须深入探究其根本原因,是网络波动、上游系统变更、还是下游处理能力不足?找到根源后,制定长期解决方案,而不是临时打补丁。

再次,将解决方案纳入版本迭代计划。针对性能瓶颈,可能是优化SQL查询、调整缓存策略或增加并发处理能力。针对数据质量问题,则可能需要升级字段校验逻辑、与上游系统协商修改数据格式或引入数据清洗工具。每一次代码或配置的变更,都必须经过严格的测试验证,确保修复有效且未引入新问题。最后,将典型的案例和解决方案沉淀为知识库,不断完善运维手册和应急预案,提升团队整体应对能力,从而实现系统的持续健壮和优化。